今年是美國大選年,兩黨的對決仿佛“昨日再現”,特朗普和拜登再次站在了擂臺之上。選舉效應從來牽連甚廣,而蝴蝶的翅膀已然影響到科技圈。

隨著總選舉的臨近,眾多科技企業在推出AI系統和大模型時都“拘謹”了不少。這種保守態度并不出人意料,萬一有人蓄意利用這些技術進行錯誤信息傳播,甚至對選舉流程或成果產生影響,那么必會招致政府的嚴格監管。

OpenAI首席技術官Mira Murati最近證實,大選是影響GPT-5發布計劃的一個重要因素。她明確表示,公司不會推出任何可能對全球選舉產生不確定影響的產品,并強調了這一點的重要性。

此外,該公司的語音合成技術也因其可能誤導選民的風險而成為焦點。這無疑讓情況雪上加霜。“我們認識到,生成與人們聲音相似的語音存在嚴重風險,尤其是在選舉年份,這一點尤為重要。”

早在2022年,一條烏克蘭總統澤連斯基的“視頻”被廣泛傳播,在視頻中,澤連斯基呼吁烏克蘭士兵放下武器。從視頻來看,澤連斯基的臉顯得很不自然,這實際是一款用Deepfake做的換頭“視頻”。

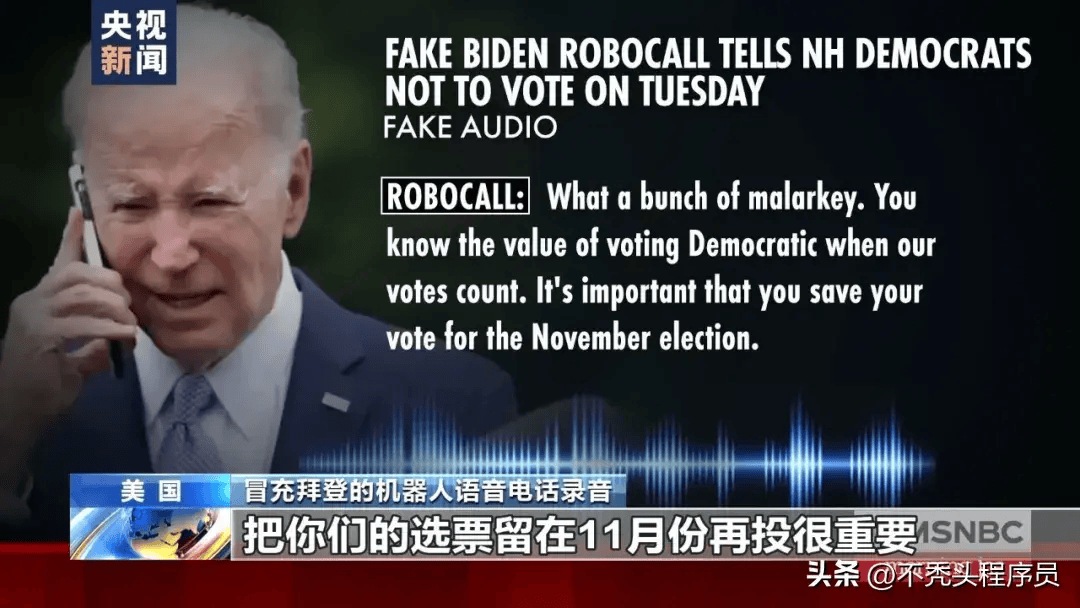

無獨有偶。今年2月,還有美國民主黨內部人士承認曾使用AI模仿總統拜登向選民撥打電話,以阻礙新罕布什爾州的初選。

圖源:央視網

最近,埃隆·馬斯克的AI聊天機器人Grok錯誤地報道了“莫迪總理被驅逐出印度政府”,引發了傳播錯誤信息的爭議。這樣的例子不勝枚舉,只是眾多類似情況中的一小部分。

不監管是問題,過度監管也是問題

盡管濫用現象泛濫,但監管進展卻慢如蝸牛。

斯坦福大學以人為本AI研究所高級研究員埃里克·布林約爾松近日警告稱,如果不加以緩解,過度監管人工智能可能成為問題。

他在接受CNBC采訪時表示:“明智的監管是有益的,甚至可以加快技術的采用并保護人們免受傷害。然而,同時,過度監管可能有害,并減緩技術的采納。”

然而,現實可能是我們正急于走向過度監管,這可能會使行業參與者合規的夢想變得遙不可及。

AI監管的現實

上周,眾議員亞當·希夫向美國眾議院提交了一項法案,要求企業在訓練人工智能系統時報告任何使用版權材料的情況。

希夫在介紹該法案時說:“人工智能具有顛覆經濟、政治體系和日常生活的潛力。我們必須在人工智能的巨大潛力與制定倫理準則和保護措施的迫切需要之間取得平衡。”

他們確實做到了平衡。希夫的法案并非針對人工智能的第一項監管措施,也肯定不是最后一項。僅去年一年,美國政府內部就圍繞人工智能監管展開了大量活動。

雖然目前尚未出臺全面的法案,各州立法機構迅速提出并通過了與人工智能相關的法案,已有超過18個州制定了相關法規,2023年共提出超過400項人工智能法案。

同時,聯邦層面也已出臺多項措施,包括人工智能權利法案藍圖和關于國家范圍內使用人工智能的行政命令。

認為人工智能難以監管的情緒似乎促使所有人都躍躍欲試。

然而,目標始終是制定一項聯邦法律,而非多部州級法規。

加利福尼亞州參議員斯科特·維納表示:“我希望能有一項統一的聯邦法律,有效解決人工智能安全問題。國會尚未通過這樣的法律。國會甚至遠未接近通過這樣的法律。”

缺乏聯邦法律可能會對整個行業產生嚴重影響,因為企業在努力適應多部法規的同時,還要面對國際監管。因此,無論是州政府還是企業自身,都對這樣的法律有著強烈需求。

未來的人工智能監管

雖然可能性很大,但是否會發生還很難說。隨著選舉臨近,民主黨和共和黨這兩黨在人工智能相關問題上卻保持了相似的立場。

民主黨承諾“動員公共和私營部門確保新產品和新發現受到法律、倫理和公民自由保護的約束”。

同樣,共和黨也表達了對人工智能監管的支持,盡管兩黨在應以何種標準進行監管的問題上存在分歧。研究表明,盡管兩黨均支持人工智能監管,但民主黨尤為關注倫理問題,而共和黨則關心人工智能能力與數據權益。

兩位總統候選人過去幾年來也都積極回應了該行業日益增長的重要性。在任期內,共和黨候選人特朗普于2020年簽署了一份行政命令,推動行業內創新。

隨后不久,國家人工智能倡議辦公室成立。

同樣,拜登政府去年也發布了確保人工智能“安全、可靠和可信”的行政命令。該命令規定了使用人工智能的安全標準。

然而,這些都是行政命令。兩黨均未承諾實施一套既易于執行又易于理解的政策,至今也未見有關全面政策的討論。

盡管普遍認為人工智能難以監管,但持續不作為可能會對整個生態體系產生嚴重影響。

隨著行業迎來重大更新,如OpenAI的GPT-5,新一屆政府如何選擇監管,對于這個行業,是成就還是摧毀,可能就在一念之間。

防不勝防,如何警惕

由于公眾人物的影像、聲音和圖像資料公開廣泛可得,為AI的訓練提供了豐富的資源,這使得名人成為AI造假的“重災區”。

行業專家提到,利用深度偽造技術生成的內容在視覺和聽覺上極為逼真,僅憑肉眼或常規技術手段很難區分真偽。攻擊者能夠利用技術手段掩蓋深度偽造的痕跡,使其難以被察覺。

目前,互聯網上充斥著大量用于訓練深度學習模型的圖片和視頻數據,這些數據同樣被深度偽造技術所利用。“數據集越龐大,模型的精準度越高,偽造內容與真實人物的相似度也就越高。”

在明顯標識之外,還可以從技術層面設計隱性標識,這樣在追蹤和溯源時,也能通過技術手段識別出內容的來源或合成途徑。如果能明確來源和合成路徑,那么風險自然變得更加可控。

參考鏈接:

https://analyticsindiamag.com/gpt-5-likely-to-be-released-after-the-us-elections/

https://news.cctv.com/2024/01/31/ARTIF8yjxViHGFxsuWPleO20240131.shtml