在AI大潮的推動下,基礎(chǔ)設(shè)施市場正在復(fù)蘇。戴爾科技近期發(fā)布了截止于2月3日的2024財年第四季度財報,第四財季營收為 93 億美元,環(huán)比增長 10%。戴爾科技業(yè)績回升主要得益于AI優(yōu)化的服務(wù)器業(yè)務(wù)的增長,本季度AI服務(wù)器訂單增長了40%,積壓訂單近乎翻倍達到29億美元,而前一季度僅為16億美元。

戴爾科技的AI服務(wù)器業(yè)務(wù)增長是整個基礎(chǔ)設(shè)施市場最新變化的一個縮影。去年以來企業(yè)對人工智能應(yīng)用的熱情不斷高漲,ChatGPT、Sora的先后爆火更是為人工智能熱火上加油,帶動了對AI基礎(chǔ)設(shè)施的強勁需求。為了滿足這些需求,以戴爾科技為代表的基礎(chǔ)設(shè)施廠商推出了不少創(chuàng)新的產(chǎn)品和技術(shù)來幫助企業(yè)擁抱AI。

AI應(yīng)用普及推動基礎(chǔ)設(shè)施升級

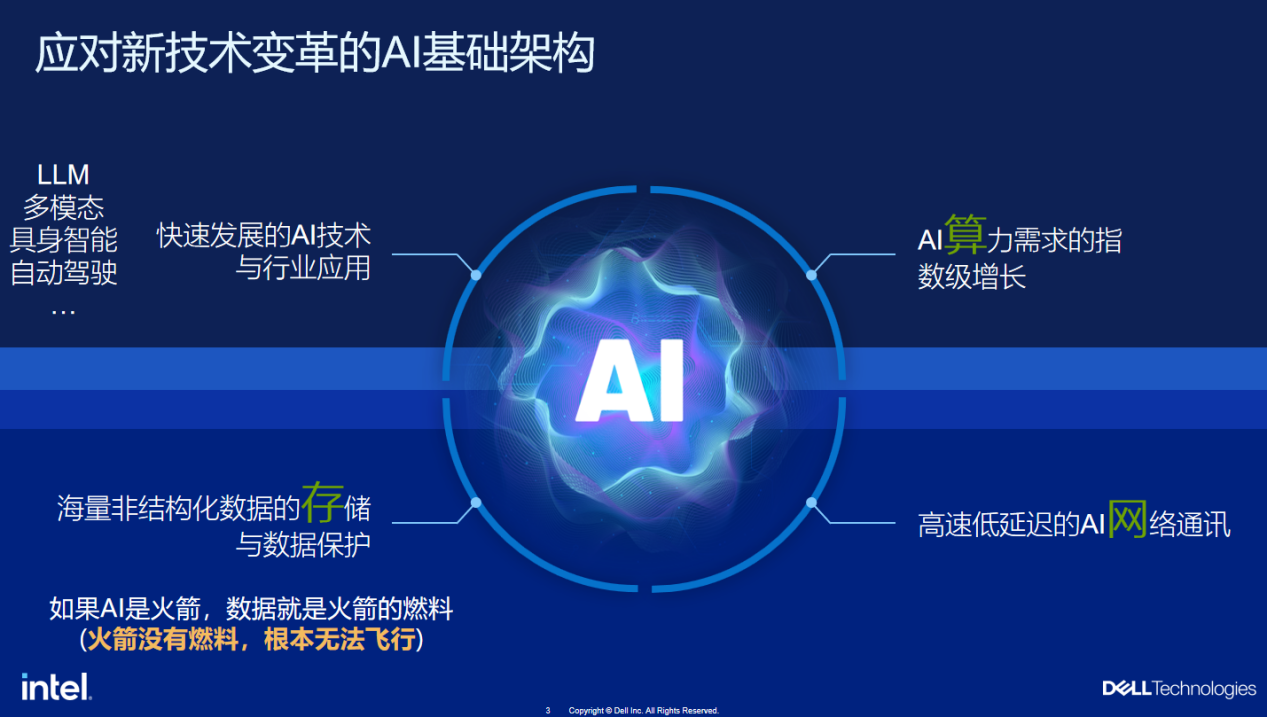

在過去的幾年里,AI應(yīng)用場景越來越豐富,智能化水平不斷提升。一個明顯的變化是,從過去集中在以圖像識別、視頻分析為主的感知智能逐漸擴展到以ChatGPT為代表的認知智能,文檔檢索、文檔生成成為了新的主流應(yīng)用場景,同時,以Sora為代表的多模態(tài)AI技術(shù)也開始方興未艾。

蓬勃發(fā)展的生成式AI應(yīng)用背后離不開底層基礎(chǔ)設(shè)施的支持。以大模型的訓(xùn)練和推理為例。大模型的參數(shù)量已經(jīng)從數(shù)十億增加到幾百億、幾萬億甚至更高,更大的模型帶來了更大的AI算力需求。有數(shù)據(jù)顯示,AI所消耗的算力平均每3~4個月就會增長一倍,而這部分增長的算力需求大部分將被GPU承擔,這直接帶動了異構(gòu)計算的普及。

另一方面,計算規(guī)模越來越大,越來越多地通過集群來承載,萬卡、十萬卡GPU規(guī)模的數(shù)據(jù)中心也不鮮見。與計算規(guī)模擴大同時增加的還有網(wǎng)絡(luò)通訊需求,讓高帶寬、低延遲網(wǎng)絡(luò)交換設(shè)施成為AI系統(tǒng)的必要組成部分。

與此同時,新興的AI應(yīng)用對存儲系統(tǒng)的要求也被提高了。功能更強、規(guī)模更大的算法模型需要搭配數(shù)量更多、質(zhì)量更高、要更加多元化的訓(xùn)練數(shù)據(jù)才可能達到預(yù)期效果,否則很容易因訓(xùn)練數(shù)據(jù)不足造成模型欠擬合,而這意味著存儲系統(tǒng)性能更高、更穩(wěn)定,同時成本更低。

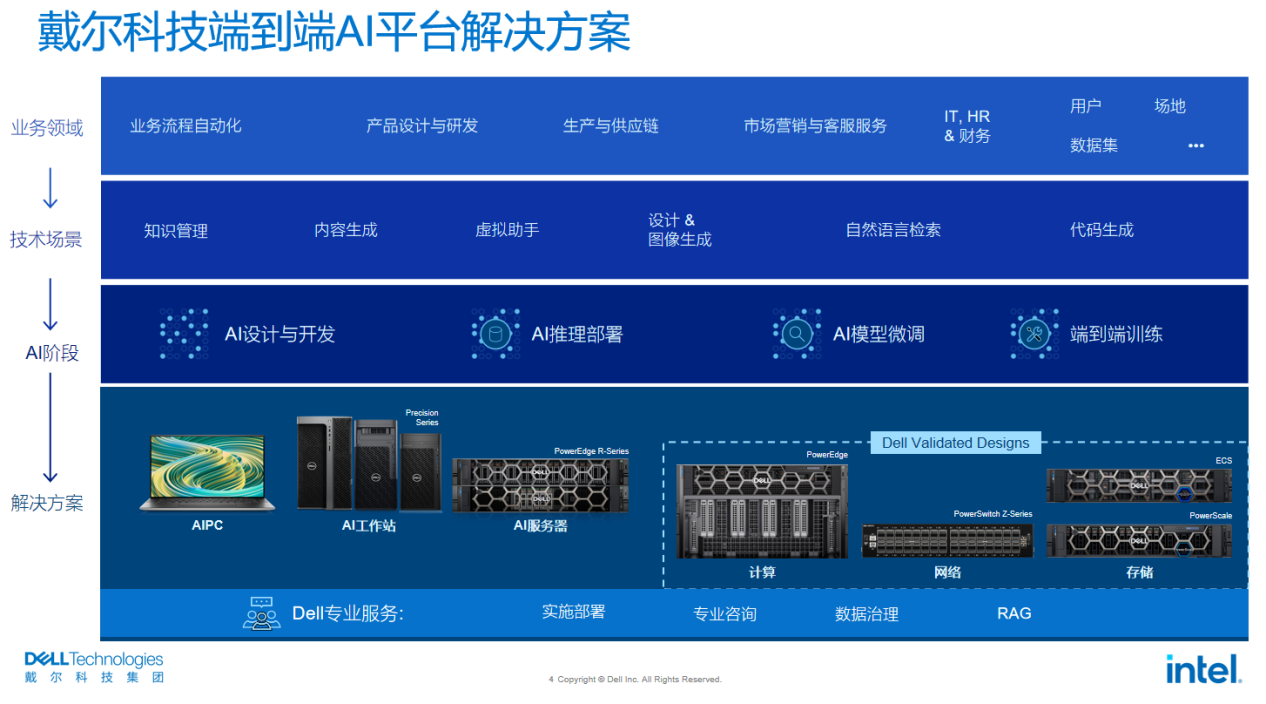

市場的需求基礎(chǔ)設(shè)施廠商都看到了,以戴爾科技為代表的很多基礎(chǔ)設(shè)施廠商也推出了大量創(chuàng)新的產(chǎn)品和技術(shù)。

多元化AI計算平臺,加速智能躍遷

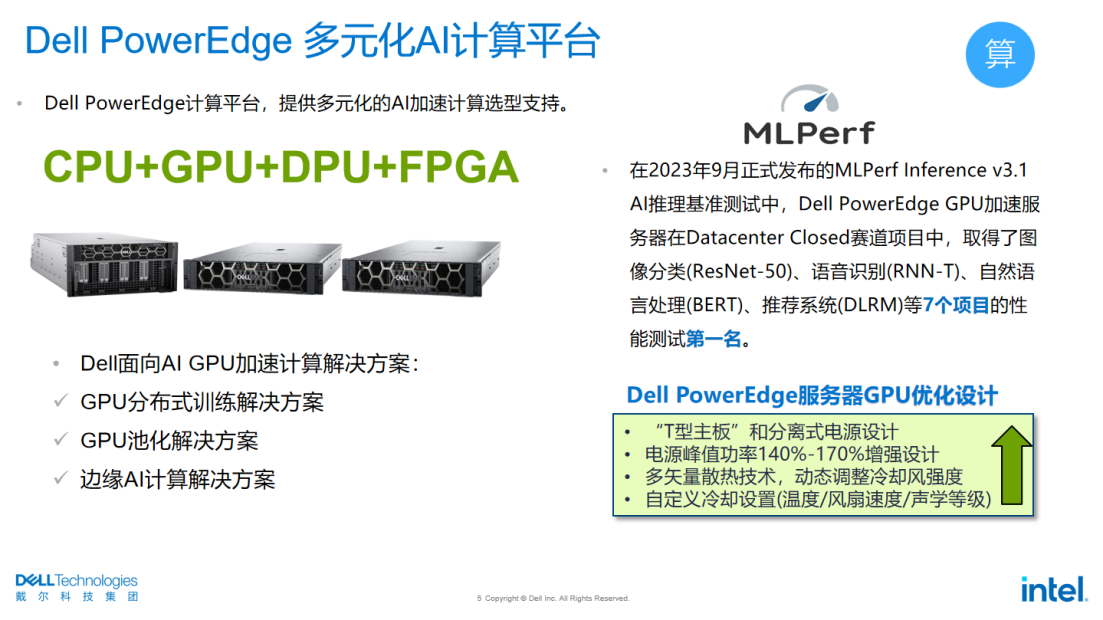

眾所周知,傳統(tǒng)數(shù)據(jù)中心的典型架構(gòu)是以CPU為中心,而今天在大模型訓(xùn)練和推理需求的推動,CPU+GPU為代表的異構(gòu)計算正在成為主流,GPU成為越來越多服務(wù)器的標準配置。順應(yīng)市場的最新需求,戴爾科技推出了多款PowerEdge服務(wù)器,它們專門針對GPU計算設(shè)計和優(yōu)化,能支持英特爾等不同品牌的GPU加速卡,可滿足不同應(yīng)用場景的需求。

“圍繞AI 應(yīng)用的GPU加速,戴爾科技能提供像GPU池化、GPU分布式訓(xùn)練、GPU集群管理和資源調(diào)度、邊緣AI計算等GPU加速計算解決方案。”戴爾科技集團信息基礎(chǔ)架構(gòu)解決方案事業(yè)部企業(yè)技術(shù)架構(gòu)師、全球CTO大使吳躍表示。

他介紹,PowerEdge 服務(wù)器設(shè)計中有很多針對GPU的專門設(shè)計。比如,多矢量散熱技術(shù)的應(yīng)用可以保證均勻冷卻服務(wù)器各部件;電源增強設(shè)計(即瞬時功率)可以達到電源標稱功率的1.4到1.7倍,以應(yīng)對GPU開機過程中的啟動風暴。這些設(shè)計都是為了確保GPU在服務(wù)器內(nèi)達到最佳運行狀態(tài)。

在AI的公開基準測試中戴爾科技PowerEdge表現(xiàn)優(yōu)異。MLPerf是當前AI領(lǐng)域關(guān)注度和參與度最高的計算性能基準測試,在去年9月份發(fā)布的MLPerf Inference V3.1的推理基準測試中,共有26個廠商提交了超過13500條的測試記錄。在20個數(shù)據(jù)中心項目賽道中戴爾科技取得了7個項目的第一名,另外4個項目的第二名。在所有參與評測的GPU服務(wù)器產(chǎn)品中取得最好的綜合成績。

除了多款GPU服務(wù)器外,戴爾科技推出的搭載英特爾Xeon Max處理器的PowerEdge服務(wù)器也值得一提。目前戴爾科技有三款服務(wù)器可以支持Xeon Max處理器,包括2U 兩路的計算平臺PowerEdge R760、1U 兩路的計算平臺PowerEdge R660以及2U 4節(jié)點PowerEdge C6620。

Xeon Max處理器是英特爾推出的業(yè)內(nèi)首款集成HBM的x86 CPU,其中集成了64GB的HBM,內(nèi)存帶寬可達到1TB/s,無需GPU加速卡就可實現(xiàn)內(nèi)存帶寬密集型應(yīng)用的加速,如模型推理與模型微調(diào)等。

相關(guān)測試表明,單個Xeon Max處理器即可完成60億、130億規(guī)模的大語言模型的加載和應(yīng)用;對于對話式AI的場景,會話首個token生成延遲小于3秒鐘,下一個token生成延遲小于100毫秒。而且,由于所有主流AI框架與加速庫都支持x86計算,在CPU上運行AI模型可以減少代碼改動量,大大簡化了AI應(yīng)用的開發(fā)和部署。

吳躍介紹,為了持續(xù)引領(lǐng)AI基礎(chǔ)設(shè)施技術(shù)創(chuàng)新,加速AI應(yīng)用的落地,戴爾科技還成立了AI HPC創(chuàng)新實驗室,專門從事AI計算、并行計算的前沿技術(shù)研究、效能的基準測試等相關(guān)工作。超級計算機Ratter就是戴爾科技AI&HPC創(chuàng)新實驗室打造的GPU超算集群。戴爾科技很多AI以及使用GPU加速的HPC解決方案(如CAE、分子動力學(xué)、生命科學(xué)等)也是在Ratter集群上首先進行測試和優(yōu)化的。

從邊到端,讓AI算力無處不在

實際上,基礎(chǔ)設(shè)施相關(guān)的技術(shù)創(chuàng)新不只是發(fā)生在計算領(lǐng)域,也發(fā)生在存儲和網(wǎng)絡(luò)領(lǐng)域,同時,也不只是在云端和數(shù)據(jù)中心,還發(fā)生在端側(cè),并正在醞釀一場從云到端、全面的升級。

比如,為了減少數(shù)據(jù)傳輸?shù)难舆t,戴爾科技PowerScale今年新增了Multipath Client driver(多通道客戶端驅(qū)動程序),借此單個客戶端就可以能實現(xiàn)40GB/s的峰值帶寬,可為高密度的GPU算力服務(wù)器提供充沛的后端存儲性能;OneFS是戴爾科技自研的文件系統(tǒng),全閃PowerScale搭配OneFS 9.7文件系統(tǒng),存儲的流式讀性能是上一代平臺的兩倍,流式的寫性能是上一代平臺的2.2倍,可以有效提高GPU在模型預(yù)訓(xùn)練和微調(diào)階段的工作效率。

當然,在端側(cè)的創(chuàng)新同樣不少。從去年9月份英特爾推出AI PC概念以來,AI PC迅速被市場接受。IDC的預(yù)測,今年新增PC中一半以上將是AI PC;2027 年將進一步提升至 84.6%。戴爾科技也全面擁抱AI PC,今年新發(fā)布的AI工作站Precision 7960單臺將支持4塊雙寬的GPU,最高配置4TB的內(nèi)存和152TB的本地存儲,為AI落地工作站提供強力支持。

談到AI在邊緣端的落地,英特爾不可不提。除了發(fā)力AI PC之外,英特爾還在其他方面持續(xù)優(yōu)化CPU面向AI應(yīng)用的性能,也為戴爾科技豐富自己的產(chǎn)品線提供更多選擇。比如,英特爾從第四代至強可擴展處理器開始新增AMX加速器,無需GPU就可顯著提升AI推理和訓(xùn)練的性能。根據(jù)英特爾的資料,AMX對于INT8精度有8倍的性能提升,對BF16精度有16倍的性能提升。而且由于AMX內(nèi)置于CPU中,因而無需專門構(gòu)建解決方案。

另一方面,英特爾也聯(lián)手合作伙伴推出面向邊緣的AI解決方案參考設(shè)計。英特爾Edge AI Box 就是其中之一,AI-BOX在搭載英特爾酷睿處理器的單一計算盒內(nèi)集成了視頻解碼和分析功能,既可作為連接到 IP 攝像頭或網(wǎng)絡(luò)錄像機 (NVR) 等視頻源的獨立設(shè)備,實時進行邊緣視頻分析,也可以連接到網(wǎng)絡(luò)并充當網(wǎng)絡(luò)上的獨立 AI 服務(wù),按需運行離線深度學(xué)習(xí)分析,部署非常方便。

“圍繞邊緣AI的落地和部署,英特爾聯(lián)合戴爾科技等合作伙伴共同打造了很多基于英特爾軟硬件棧的邊緣AI解決方案,以支持無處不在的AI應(yīng)用。”英特爾中國解決方案部AI架構(gòu)師俞巍表示。

實際上,除了英特爾外,戴爾科技還與很多廠商有合作,其中與ISV合作研發(fā)面向細分領(lǐng)域的解決方案就是一種重要的合作方式。

當下,向量數(shù)據(jù)庫+大模型的RAG(檢索增加)非常熱門。因為RAG既可以發(fā)揮大模型的語言生成能力,又可以借助向量數(shù)據(jù)庫解決大模型的幻覺問題,被認為是一種非常有應(yīng)用前景的AI落地形式。達觀數(shù)據(jù)一家專注于智能文本處理技術(shù)的國家級專精特新“小巨人”企業(yè),其智能知識管理系統(tǒng)在行業(yè)內(nèi)擁有不少用戶,現(xiàn)在戴爾科技就在和達觀數(shù)據(jù)合作,共同探索RAG技術(shù)與智能知識管理的融合解決方案。

戴爾科技推出的經(jīng)過驗證的各種參考設(shè)計(AI Validated Design Solution)以及配套的技術(shù)白皮書和效能的驗證,其中就離不開各種合作伙伴的支持。

“隨著AI技術(shù)的迭代,AI場景與AI模型規(guī)模越發(fā)復(fù)雜,對AI算力與AI訓(xùn)練數(shù)據(jù)的需求也會更加地旺盛,AI基礎(chǔ)設(shè)施未來幾年將會持續(xù)成為全球IT投資的熱點之一。”吳躍表示,作為領(lǐng)先的基礎(chǔ)設(shè)施供應(yīng)商,戴爾科技會和合作伙伴一起積極擁抱AI,通過技術(shù)創(chuàng)新推動基礎(chǔ)設(shè)施的升級,加入AI應(yīng)用的普及。