智東西

編譯 | Glu

編輯 | 李水青

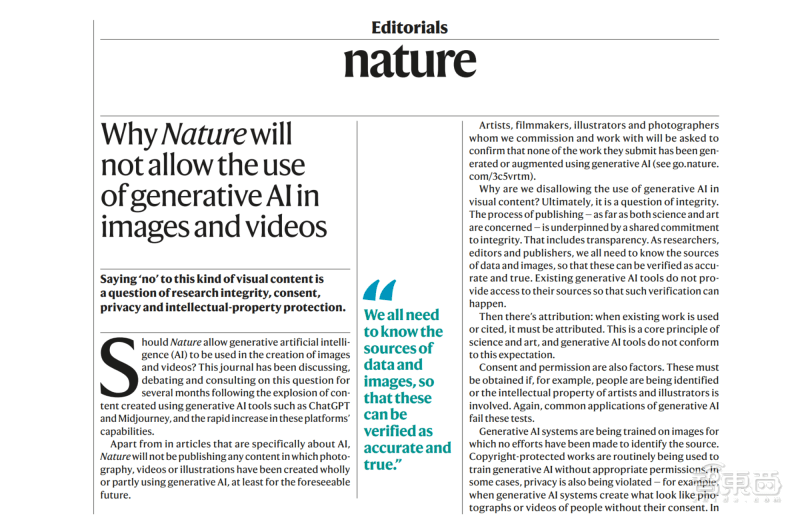

智東西6月15日消息,近日,著名科學(xué)期刊Nature在一篇社論中重磅宣布:出于研究的誠信、許可、隱私和知識產(chǎn)權(quán)保護等方面的考慮,該期刊將不會刊登包含AI創(chuàng)作圖像或視頻的投稿。

Nature創(chuàng)刊于1869年11月,主要發(fā)表科學(xué)和技術(shù)領(lǐng)域各個學(xué)科的重要突破,是世界上被引用最多、最具影響力的科學(xué)期刊之一。事實上,這也不是Nature第一次限制AIGC(生成式AI)了,今年1月,Nature就規(guī)定大模型(LLM)不可以成為作者,此次的要求則是延展到了視覺元素。

文章鏈接:https://www.nature.com/articles/d41586-023-01546-4

一、4大難題,讓Nature拒絕AIGC視覺元素

面對來勢洶洶并不斷迭代升級的各類AIGC工具,尤其是ChatGPT、Midjourney,Nature經(jīng)過數(shù)月的討論與協(xié)商,終于明確了AIGC視覺作品的發(fā)表規(guī)定:“未來,除了針對AI的文章,Nature不會發(fā)表任何完全或部分使用AIGC進行創(chuàng)作的照片、視頻或插圖。”

其一,Nature認為AI創(chuàng)作的藝術(shù)作品無法滿足學(xué)術(shù)規(guī)范中的誠信準則:

“為什么我們不允許在視覺內(nèi)容中使用生成AI?歸根到底,這是一個誠信問題。就科學(xué)和藝術(shù)而言,學(xué)術(shù)作品的出版過程需要堅持誠信原則,誠信的考量包括過程和方法的透明,研究人員、編輯和出版商都需要知道數(shù)據(jù)和圖像的來源,這樣才能驗證這些數(shù)據(jù)的準確性和真實性。現(xiàn)有的AIGC工具無法訪問其來源,因此無法進行此類驗證。”

因此,Nature雜志要求:所有需要發(fā)表作品的藝術(shù)家、電影制作人、插畫家和攝影師,都要提前確認他們提交的所有作品均未使用AIGC工具。

▲這位藝術(shù)家的圖片不是AI 生成的,因此被Nature允許發(fā)布

其二,歸屬權(quán)問題,AIGC作品的歸屬權(quán)不明確,這些圖像通常是由輸入AI模型的數(shù)百萬張圖像合成而成。

其三,同意與許可問題,尤其是與個人身份或知識產(chǎn)權(quán)有關(guān)的同意與許可。如果涉及知識產(chǎn)權(quán)的內(nèi)容,必須獲得同意與許可后才能使用,但AIGC常在未獲得必要許可的情況下使用受版權(quán)保護的作品進行訓(xùn)練。

▲由圖像合成模型Stable Diffusion生成的機器人肖像,每個都結(jié)合了從不同藝術(shù)家那里學(xué)到的元素

其四,深度偽造(DeepFake)問題,Nature認為AIGC內(nèi)容的深度偽造會加速虛假信息的傳播。

▲美總統(tǒng)候選人Ron DeSantis競選視頻的屏幕截圖顯示了真實和虛假圖像的拼貼畫。

二、Nature態(tài)度強硬:等法規(guī)完善了再說

Nature雖然對AIGC生成的視覺內(nèi)容不予采用,但并不完全反對使用AI工具。該期刊仍允許投稿包含ChatGPT等AIGC工具生成的文本,前提是這些LLM的使用必須明確記錄在論文的方法或致謝部分中。

此外,所有數(shù)據(jù)的來源,即使是那些在AI幫助下生成的數(shù)據(jù),也必須由作者提供。不過,正如前文所說的,該期刊早已明確聲明,任何LLM工具都不會被視為論文作者。

許多出版物偶爾也會為了完善文章整體閱讀與傳播效果而使用AI生成的圖像或視頻,但Nature堅定地認為:“許多國家的監(jiān)管和法律體系仍在制定應(yīng)對AIGC興起的措施,在合適的應(yīng)對措施出臺前,Nature作為研究和創(chuàng)意作品的出版商,我們將持續(xù)拒絕那些使用AIGC創(chuàng)建視覺內(nèi)容的作品。”

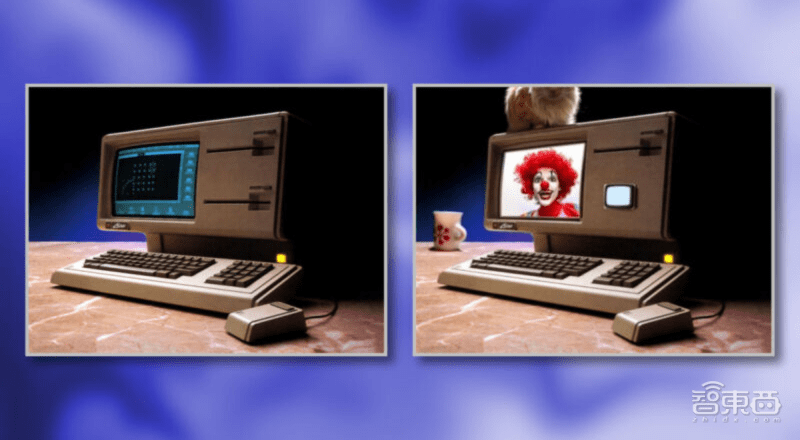

然而,隨著AIGC不斷融入Photoshop等傳統(tǒng)圖像編輯工具,像Nature這樣的傳統(tǒng)出版物可能最后會發(fā)現(xiàn):它們很難在AI與非AI藝術(shù)之間劃清界限。就在最近,Adobe將AIGC工具引入了 Photoshop測試版,由其Adobe Firefly引擎提供支持。在此之前,Adobe幾十年來一直使用AI算法為其許多內(nèi)置工具提供支持。

▲Apple Lisa計算機1983年文件照片的示例(左),通過Adobe Photoshop測試版中新的“生成填充”AI工具得到顯著增強。

結(jié)語:Nature嚴禁AIGC視覺元素,謹慎保護科研人員權(quán)益

世界正處于人工AI革命的邊緣,這場革命前景廣闊,但AI,尤其是AIGC也在迅速顛覆科學(xué)、藝術(shù)、出版等領(lǐng)域長期確立的慣例與規(guī)矩。

科學(xué)家們需要建立一個保護科學(xué)完整性、保護科研人員權(quán)益的規(guī)定與條例,但新條例可能需要很長時間才能完善。在這期間,則需要更為小心謹慎地處理AI問題,否則,過往的那些收益都有可能化為泡影,這也是Nature選擇保守面對AIGC直到相關(guān)規(guī)定成型的最大原因。

來源:Ars Technica、Nature官網(wǎng)