大公司動作遲緩,員工向硅星人透露谷歌如何陷入兩難境地。

文|杜晨 編輯|VickyXiao

來源 | 硅星人

圣誕節(jié)前,《紐約時報》報道,因為 ChatGPT 在全球爆紅,谷歌CEO Sundar Pichai 在公司內(nèi)部發(fā)布了“紅色警報” (Code Red)。

在 ChatGPT 剛發(fā)布時,有首批測試網(wǎng)友發(fā)言宣稱“ChatGPT 太強了,能夠替代谷歌搜索”,當時谷歌高層對此置之腦后,表示不太擔心。

然而僅僅過了不到一個月,谷歌高層對于此事件的態(tài)度就180度大轉彎——很顯然,Pichai 的判斷是 ChatGPT 真的對谷歌帶來了巨大的威脅。

在最近一周時間里,硅星人和多位目前正在或曾在谷歌 AI、搜索等部門從事模型開發(fā)、產(chǎn)品設計和商業(yè)推進的員工進行了溝通。

通過這些匿名對話,我們試圖了解本次“紅色警報”事件究竟是怎么回事,有多嚴重,以及谷歌對于 ChatGPT,對于聊天機器人對搜索引擎的替代威脅,究竟是怎么看的。

| 何為紅色警報?

一些受訪谷歌員工告訴硅星人:

谷歌為 ChatGPT 亮起“紅色警報”這件事,并不是一件特別稀有的事情;其“致命性”,并沒有外界所想象的那么高。

事實上,谷歌在過去曾經(jīng)多次為公司產(chǎn)品和內(nèi)部生產(chǎn)系統(tǒng)發(fā)出“紅色警報”。

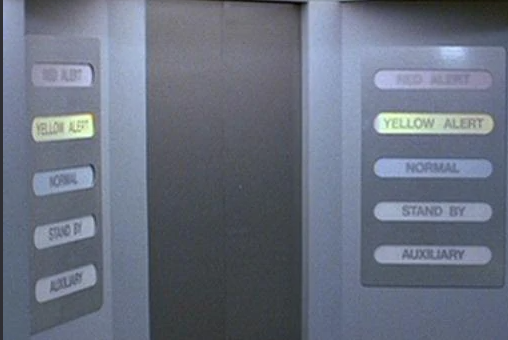

在硅谷,科技公司慣用這樣的一套“顏色警報”系統(tǒng),其靈感來自于《星際迷航》的飛船防御警報,按照緊迫程度從低到高,包括綠、藍、黃、紅等顏色(如下圖)。包括谷歌、LinkedIn 以及許多知名硅谷科技公司,都在使用這套顏色警報系統(tǒng)。

圖片來源:派拉蒙

具體對于谷歌來說,公司的內(nèi)部系統(tǒng)、產(chǎn)品、生產(chǎn)系統(tǒng)出現(xiàn)問題時,都會使用這套顏色警報來標注其緊迫性:

黃色警報 (Code Yellow)指的是近期內(nèi)可能會對系統(tǒng)或產(chǎn)品造成威脅的事件。

“比方說我們的某個產(chǎn)品的硬盤就快不夠用了,或者我們在用的某個第三方 API 要 deprecate(棄用)了,這樣的時候我們就有可能會發(fā)布 code yellow,”一位前谷歌員工告訴硅星人。

在谷歌,黃色警報的意思可以理解為:我們面臨(或者預計將會面臨)這個問題,但是情況并不嚴重。大家要注意到這個事情的存在,特定的人員在工作時間里需要將其作為主要優(yōu)先級,但是還沒到加班加點修復的程度,只要在警報期內(nèi)工作時間內(nèi)完成即可。

這里就提到了警報期的概念:通常黃色警報可以持續(xù)更長的時間,幾周、一個季度,甚至更長時間都有——這主要是因為黃色警報所針對的往往都是時效較長,沒那么緊迫的問題。

紅色警報就不一樣了,它代表的是當前、緊急、直接的危機。

“紅色警報對應的是真實生產(chǎn)環(huán)境的重大事故,比方說整個搜索或者 Gmail 產(chǎn)品,或者產(chǎn)品的一個重要的功能,在意料之外的情況下突然掛了,那就要發(fā) code red 了,就算加班不睡覺也得趕緊修,”一位谷歌員工說道。

“但是紅色警報不會持續(xù)很久,問題解決就可以取消了,聽同事說最長也就幾天。”

通常當紅色警報發(fā)出的時候,修復的代碼可以立即推送到生產(chǎn)系統(tǒng)里,無需經(jīng)過測試系統(tǒng)審核試運行等常規(guī)流程。因為當紅色級別的事故發(fā)生時,解決事故是第一優(yōu)先級,有其它 bug 的話可以后續(xù)再修復。

多位谷歌現(xiàn)員工告訴硅星人,這次并不是公司里的生產(chǎn)系統(tǒng)或產(chǎn)品真的遇到了問題,而是一次帶有比喻性質(zhì)的紅色警報。

眾所周知,從感恩節(jié)開始到12月和圣誕節(jié)這一個月的“假日季”里,大部分科技公司都進入放假休息的節(jié)奏和狀態(tài)了,不會有太多太正經(jīng)的事情需要做,員工們進入放假心態(tài),也都已經(jīng)比較放松了。

按照紅色警報的慣例,它的持續(xù)時間不會很長,最多也就幾天——就算形勢再緊迫,也不能不讓大家踏踏實實過圣誕節(jié)吧?

當然,這并不意味著 ChatGPT 對谷歌所造成的威脅就結束了。

而 Pichai 拉響這次警報,大概的意思是:

“你們要把這次 ChatGPT 對谷歌帶來的威脅,當做和谷歌搜索宕機事故一樣的嚴重性看待。”

Pichai 以及谷歌高層,其實是希望“敲醒”谷歌公司內(nèi)部負責同類技術和產(chǎn)品開發(fā)的團隊,讓他們趕緊上上心,別再“夢游”了……

在紅色警報持續(xù)的時間里,谷歌公司內(nèi)部負責研發(fā)同類技術和產(chǎn)品開發(fā)的團隊,也在緊鑼密鼓地開會商討對策,盡快制定出大方向和時間軸,為節(jié)后的工作鋪平道路。

| 這次紅警事件,谷歌員工怎么看?

一位接近谷歌大規(guī)模語言模型團隊的員工向硅星人透露,從理論上 ChatGPT 本身對谷歌無法構成任何實質(zhì)性的威脅。

“理論上,ChatGPT 不是什么新鮮事。它背后的基礎模型 GPT3/GPT3.5 早就問世了,谷歌對于這些 OpenAI 模型的能力也是有了解的。要說 OpenAI 的大模型和類似模型(包括谷歌模型)之間技術差距,沒辦法很準確地形容,總的來說沒多大差距。”

“換句話說,谷歌在大語言模型、聊天機器人的技術上,跟 ChatGPT 是平起平坐的,或者跟 OpenAI 的核心技術相比起來,沒有落后的太夸張。”該員工表示。

然而在現(xiàn)實世界里,“理論上”往往是不管用的。

事實上,ChatGPT 完成了之前 GPT-3 和 OpenAI API(基于 GPT-3 的商業(yè)產(chǎn)品)發(fā)布的時候都沒能完成的壯舉——它成為了第一個從AI學術界破圈進入主流用戶群體的產(chǎn)品。

大家應該對最近爆紅的 ChatGPT 不陌生了。所有的媒體都在報道它,每一個網(wǎng)友都在注冊使用它,還有更多沒有機會注冊的網(wǎng)友,通過科技博主和媒體持續(xù)對它進行關注。網(wǎng)友們分享和 ChatGPT 之間的各種神奇對話,一度占領了所有海外社交媒體平臺,以及相當大比例的國內(nèi)社交網(wǎng)絡科技圈的話題,成為了最受歡迎的內(nèi)容種類。

也正是 ChatGPT 破圈進入主流這件事,讓谷歌緊張了。

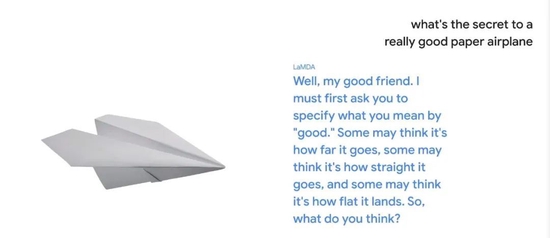

早在去年開發(fā)者大會 I/O 上,谷歌就已經(jīng)發(fā)布了專門針對對話類應用的大語言模型 LaMDA (Language Model for Dialog Applications) 和多模態(tài)多任務模型 MUM (Multitask Unified Model)。

這兩個模型,在實際上已經(jīng)具備了和 ChatGPT 基本相同的能力。而且在去年谷歌已經(jīng)通過官方演示和小范圍內(nèi)測應用,向公眾展示了這兩個模型在多輪對話、文本生成、跨模態(tài)搜索等多種任務上的強大能力。

(我本人當時也參與了 LaMDA 對話能力內(nèi)測,這也是為什么前幾天 ChatGPT 突然爆紅的時候,我并沒有感覺非常驚訝。)

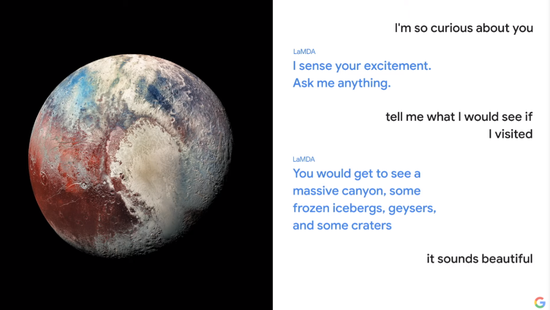

谷歌 LaMDA、MUM 模型和應用演示 圖片來源:谷歌

既然谷歌已經(jīng)有自己的同類產(chǎn)品,甚至比 ChatGPT 問世還早,它為什么這次要這么緊張呢?

一位接近谷歌大語言模型團隊的員工表示,谷歌現(xiàn)在的問題是:從去年 I/O 大會到現(xiàn)在,LaMDA 發(fā)布已經(jīng)有一年半的時間了,卻仍然沒有像 ChatGPT 那樣面向公眾大規(guī)模開放。

而谷歌這次突然發(fā)布紅色警報,希望解決的也正是這個起大早趕晚集的問題。

說白了,谷歌認識到:LaMDA/MUM 明明更早發(fā)布,卻落后于 ChatGPT,是一個重大的錯誤,其嚴重性和緊迫性,應該被當作真實生產(chǎn)環(huán)境事故一樣對待。

圖片來源:網(wǎng)絡

至于是什么導致了谷歌在 AI 產(chǎn)品上不敢冒進?答案比較復雜,但總的來說有兩條:

原因其一:谷歌在 AI 道德的議題上,目前處于一種害怕冒進的狀態(tài)。

前幾年谷歌內(nèi)部發(fā)生了多起 AI 道德丑聞,包括女性少數(shù)族裔研究員的論文被公司打壓、為外國政府開發(fā)敏感技術產(chǎn)品(和極權曖昧)等。結果,這家公司害怕在道德上“再次出問題”。

這一情況,在前段時間 ChatGPT 爆紅之后外媒對谷歌缺乏反應的報道中也有所體現(xiàn)。當時這些外媒報道指出,谷歌擔心開發(fā)出競品投放到市場之后,因為模型調(diào)校不佳再次發(fā)生事故,對本就難以維持的公司道德形象進一步造成打擊

原因其二:即便谷歌發(fā)布了 ChatGPT 的競品,這樣的產(chǎn)品也會對谷歌當前的商業(yè)模式造成顛覆。

這一條更好理解了,簡直是大公司的通病了。

谷歌的核心營收來源是廣告。搜索廣告、結果排序、頁面廣告,以及其他任何廣告展示方式——無論如何,只有當廣告位存在,廣告能夠被展示的時候,谷歌才能賺錢。

所有的聊天機器人,以及在前幾年非常流行的“對話即服務/即界面” (conversation as a service/interface) 的概念當中,都是不應該包含廣告的。

仔細想想:你跟一個朋友對話的時候,如果他時不時地突然地跟你念兩句廣告詞……那不是瞬間出戲了嗎?

圖片來源:派拉蒙網(wǎng)絡

從這一點上來看,LaMDA 商業(yè)化進展慢,落后于 ChatGPT/OpenAI,并不是谷歌 LaMDA 團隊的錯。

舉例:作為一個更早的“聊天機器人”產(chǎn)品,google Assistant 在商業(yè)化上至今沒有頭緒,蘋果 Siri 被用戶罵太蠢,亞馬遜Alexa 則因為老是忍不住幫用戶買東西而被用戶指責過于激進。夾在中間的 Google Assistant 好不容易取得一個平衡,打破這個平衡未免太可惜了。

但是需要明確的是,聊天機器人商業(yè)化這件事,并不是沒法做——只是對于負累太多的大公司來說難做而已。

對于 OpenAI 以及更小更新的創(chuàng)業(yè)公司來說,它們真的可以隨便做……

一位熟悉 OpenAI 研究水平的谷歌員工表示,如果 OpenAI 想要在 ChatGPT 的基礎上加入搜索功能,并不是一件非常難的事,“也許一兩個季度”就可以開發(fā)完成。

事實上,業(yè)內(nèi)已經(jīng)有不少創(chuàng)業(yè)公司在基于現(xiàn)成大語言模型的聊天機器人基礎上,增加搜索的功能/模塊了。比如 Perplexity、YouChat 等等,都在做這樣的事情。

別提小公司,就連大公司也在虎視眈眈:別忘了 OpenAI 之前已經(jīng)和微軟簽了戰(zhàn)略合作協(xié)議。

而 OpenAI 有大模型和聊天機器人,微軟有必應搜索。單獨看這兩個東西,對谷歌都構不成實質(zhì)性的威脅。但如果它們來一個“強強聯(lián)手”,那就不好說了。

“ChatGPT 現(xiàn)在還不能搜索,這是沒錯。”前述員工表示,“但是就算沒有搜索,從我們的測試分析來看,ChatGPT 已經(jīng)能夠比較好地回答相當大一部分的谷歌搜索提問了。”

——也許這才是谷歌拉響紅色警報的真實內(nèi)在原因。

在 ChatGPT 和谷歌搜索,在 OpenAI 和谷歌兩家公司的身上,我們也許正在親眼目睹小公司對大公司的又一次技術顛覆。在硅谷,最近幾年,這樣的事情已經(jīng)越來越罕見。

好在谷歌已經(jīng)意識到了自己正在面臨生死存亡級別挑戰(zhàn)的事實。

接下來它究竟是渡過難關,還是被 ChatGPT 以及后續(xù)產(chǎn)品技術所顛覆和取代,就要看這家公司里的成千上萬名聰明人,能否在有限的時間里,盡快開發(fā)出一個既能在道德上過得去,又不會蠶食自己核心廣告收入來源的新產(chǎn)品了。

亦或者,收購 OpenAI 也未嘗不可。畢竟谷歌不缺錢,之前也收過 DeepMind。只是在越來越嚴苛的美國科技反壟斷大勢之下,谷歌能否最終得償所愿,就要看監(jiān)管者的心情了。