金磊 豐色 發(fā)自 凹非寺

量子位 | 公眾號 QbitAI

家人們,現(xiàn)在做個 影視級視頻,也就是一句話的事了!

例如只需簡單輸入“叢林 (Jungle)”,大片鏡頭便可立刻呈現(xiàn):

而且圍繞著“叢林”變換幾個搭配的詞語,比如“河流”、“瀑布”、“黃昏”、“白天”等,這個AI也能秒懂你的意思。

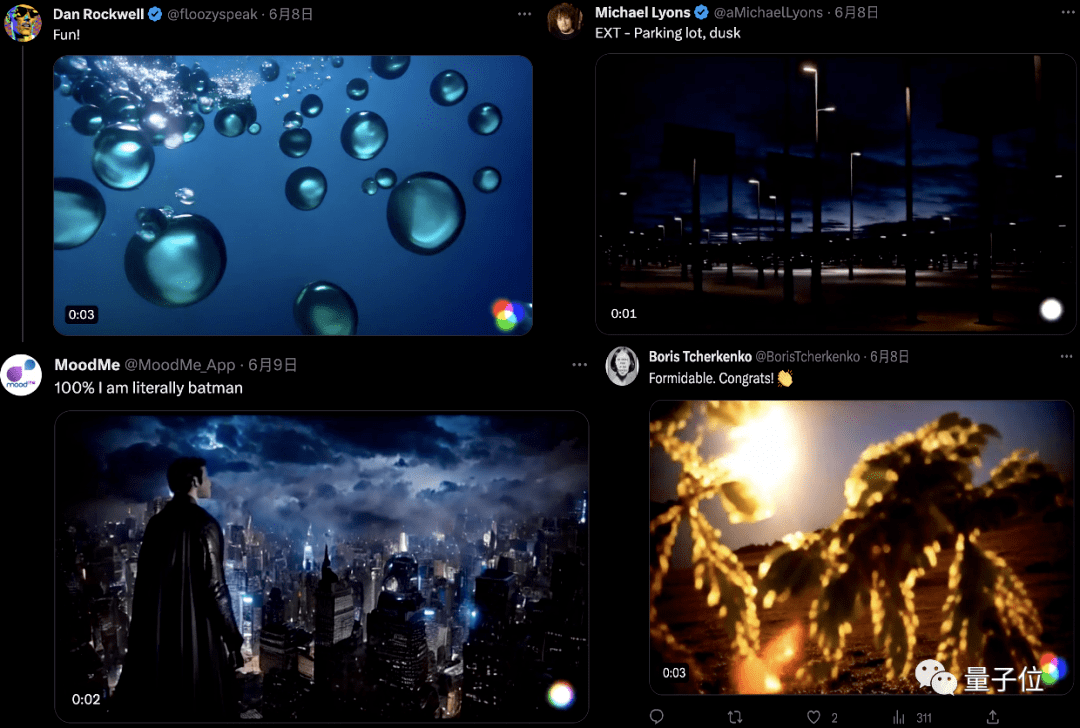

還有下面這些自然美景、宇宙奇觀、微觀細胞等高清視頻,統(tǒng)統(tǒng)只需一句話。

這就是Stable Diffusion和《瞬息全宇宙》背后技術(shù)公司Runway,出品的AI視頻編輯工具Gen2。

而且就在最近,一個好消息突然襲來——Gen2可以 免費試用了!

這可把網(wǎng)友們開心壞了,紛紛開始嘗鮮了起來。

體驗Gen2實錄

如此好玩的技術(shù),我們當然也要親手體驗上一番。

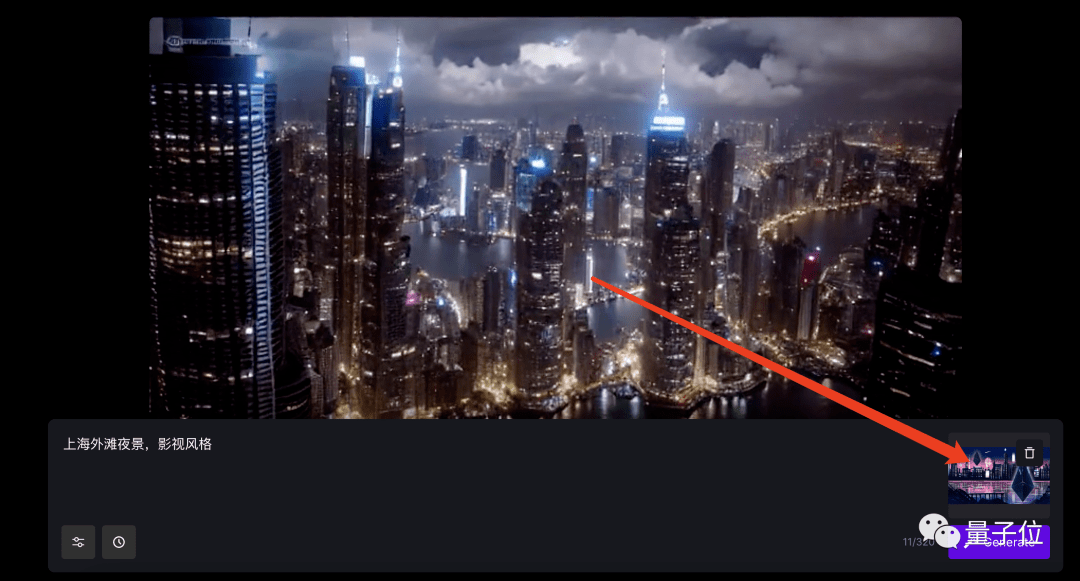

例如我們給Gen2投喂了一句中文:

上海外灘夜景,影視風格。

一個航拍視角的視頻片段便立即被做了出來。

如果想讓視頻的風格變換一下,也可以上傳一張圖片,例如我們用的是一張賽博朋克風格的城市照片。

那么Gen2就會把你輸出的提示詞和照片風格做一個“合體”:

目前Runway官網(wǎng)可免費體驗Gen2的功能是文生視頻 (Text to Video),但Gen1也開放了視頻生視頻 (Video to Video)的功能。

例如一個國外小哥可能受《瞬息全宇宙》的啟發(fā),憑借Gen1也玩了一把更刺激的穿越。

他先是在家錄了一段打響指的視頻,然后“啪的一下”,瞬間讓自己步入歐洲皇室貴族的“片場”:

然后……就連物種、性別,都可以隨隨便便地切換:

最后,再經(jīng)歷幾次不同時空、人種的穿越之后,小哥一個響指又回到了自己的家里:

在看完Gen2生成的這波“大秀”之后,網(wǎng)友們不淡定了,直呼:

娛樂圈要被生成式AI重新定義了。

PC、手機都能玩

網(wǎng)頁端和移動端 (僅限IOS系統(tǒng))現(xiàn)在均可正式開始體驗。

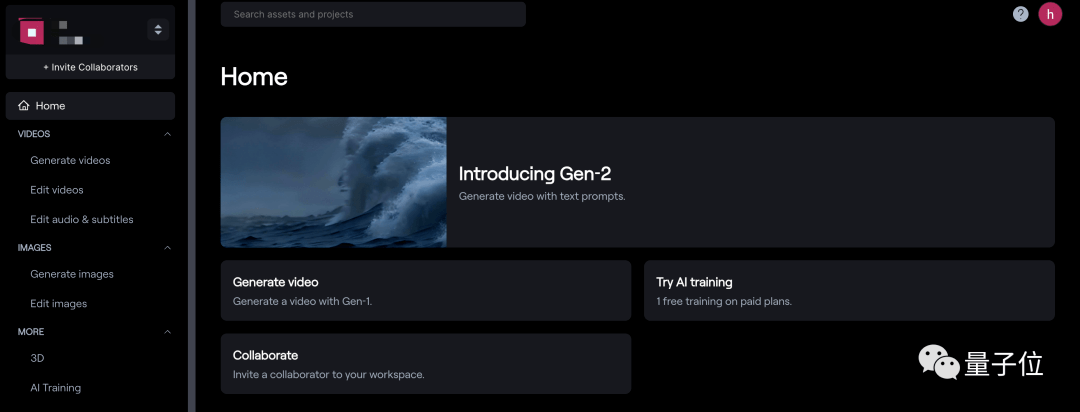

以網(wǎng)頁端為例,進入Runway官方主頁 (文末鏈接[1]),點擊上方“TRY NOW”并注冊賬號,就可以進入下面的界面:

點擊右方的“Introducing Gen2”,我們就可以正式開玩了。

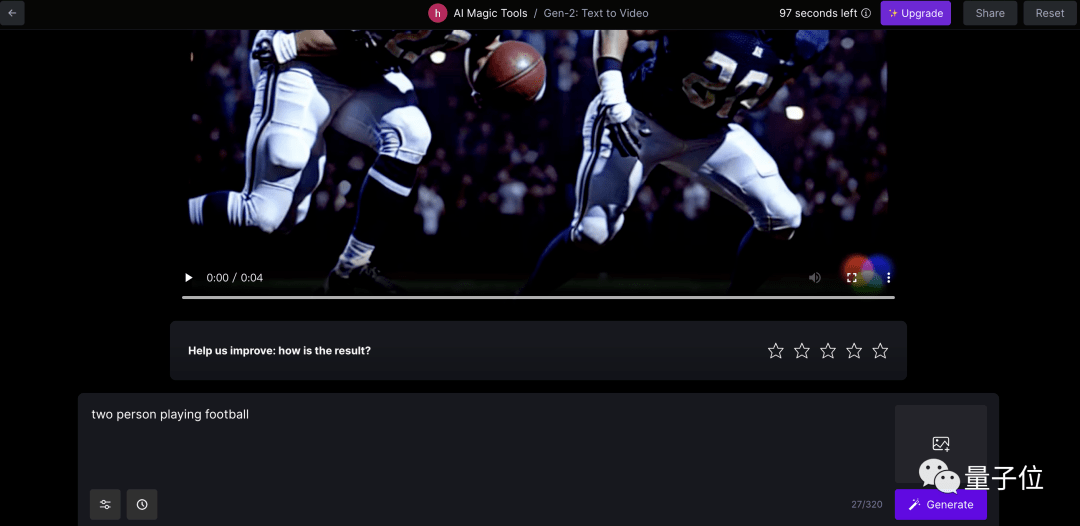

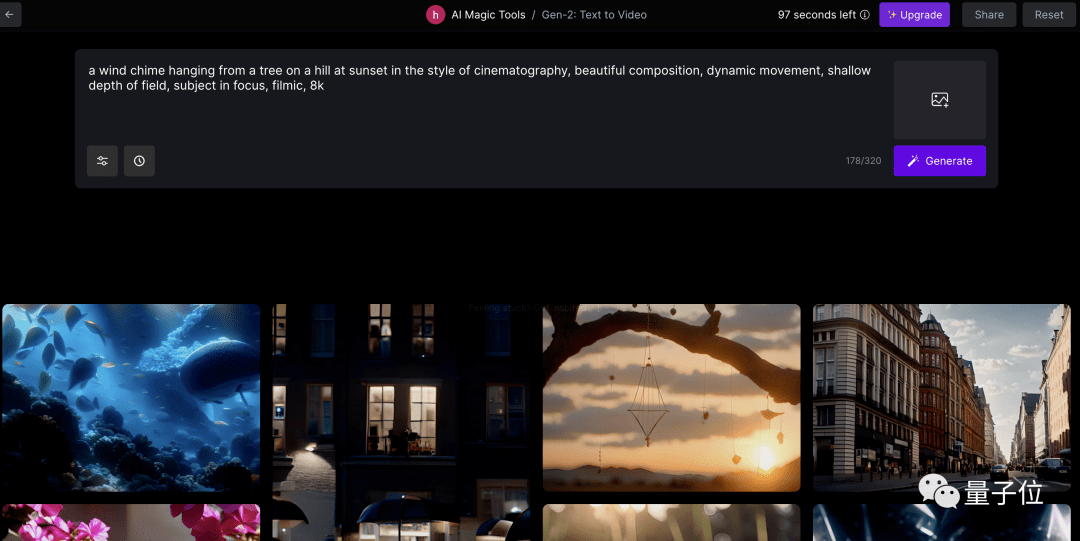

首先,輸入提示詞,最多320個字符,然后在左邊的設(shè)置菜單里進行一些基礎(chǔ)配置 (包括種子參數(shù)、插值等),點擊“Generate”。

(當然,你也可以為視頻提供一張參考圖像,點擊右邊的圖像圖標即可。)

不到1分鐘的功夫,視頻就出來了。

點擊下方播放按鈕即可查看效果,視頻可以直接保存到本地,也可以只保存在你的賬戶中。

當然,如果你不滿意,還能在下方的提示詞框中繼續(xù)修改。

需要注意的是, 免費試用的額度為105秒(右上角顯示剩余額度),每個視頻為4秒,也就是大約可免費生成26個Gen2視頻。

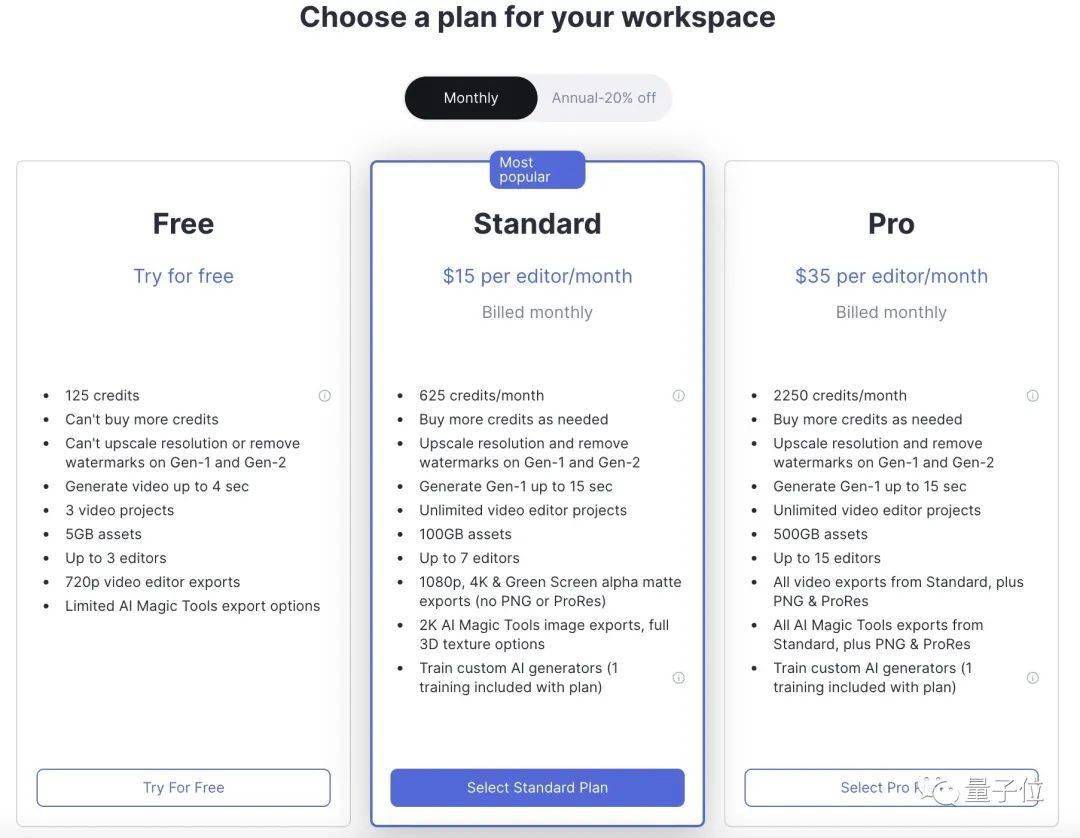

額度用完或者你想體驗去水印、提升分辨率等額外功能,就需要買會員,標準版為15美元一個月,Pro版35美元,年付更便宜一些。

如果你想要生成效果更好,可以多使用 “in the style of xxx”的形式,比如:

A palm tree on a tropical beach in the style of professional cinematography, shallow depth of field, feature film. (如下圖)

A palm tree on a tropical beach in the style of 2D animation, cartoon, hand drawn animation.

或者直接去它的靈感庫,選擇一個你喜歡的視頻然后點擊“try it”即可查看它的提示詞是怎么寫的,然后在上面進行編輯或模仿就好了:

還有網(wǎng)友表示,使用 “cinematic shot of”開頭,也能讓你的視頻更具動感 (解決了很多人試出來的視頻不怎么動的問題)。

什么來頭?

Gen2于今年3月20日正式發(fā)布,經(jīng)歷了兩個多月的內(nèi)測,現(xiàn)在終于正式上線。

它的前代Gen1只比它早了一個多月 (2月發(fā)布),所以說迭代速度相當快。

作為一個基于擴散的生成模型,Gen1通過在預(yù)訓(xùn)練圖像模型中引入時間層,并在圖像和視頻數(shù)據(jù)上進行聯(lián)合訓(xùn)練,完成了潛擴散模型到視頻生成領(lǐng)域的擴展。

其中也包括使用一種全新的引導(dǎo)方法完成了對生成結(jié)果時間一致性的精確控制。

其架構(gòu)如圖所示:

在訓(xùn)練階段,先用固定編碼器將輸入視頻x編碼為z 0 ,并擴散為z t 。

然后對MiDaS獲得的深度圖進行編碼,提取出結(jié)構(gòu)表示s;再用CLIP對其中一個幀進行編碼來獲取內(nèi)容表示c。

接著,在s的幫助下,模型學(xué)習反轉(zhuǎn)潛空間中的擴散過程 (其中s與c以及通過交叉注意塊生成的c相連)。

在推理階段,模型以相同的方式提供輸入視頻的結(jié)構(gòu)s。

為了通過文本生成內(nèi)容,作者還通過一個prior將CLIP文本嵌入轉(zhuǎn)換為圖像嵌入。

最終,Gen1可以生成細粒度可控的視頻,也能對一些參考圖像進行定制。

不過,一開始對公眾發(fā)布的Gen1只能對已有視頻進行編輯,Gen2才直接完成了文生視頻的“蛻變”。

并且一口氣帶來了另外7大功能,包括文本+參考圖像生視頻、靜態(tài)圖片轉(zhuǎn)視頻、視頻風格遷移等等。

這樣的Gen2,也在內(nèi)測階段就被網(wǎng)友稱贊 “視頻界的Midjourney”。

而根據(jù)官方的調(diào)研數(shù)據(jù),Gen2確實更受用戶歡迎:用戶得分比Stable Diffusion 1.5要高73.53%,比Text2Live則高上了88.24%。

如今正式上線以后,果然迅速迎來一大波體驗群眾,有人表示:

上一次體會到這么激動的感覺,還是用AI生成圖像的時候。

那么,不知道這波,參與開發(fā)了SD的Runway,能否再帶著Gen2創(chuàng)造生成式AI領(lǐng)域的下一大熱趨勢——

如果答案是肯定的,還需要多久、還要解決哪些問題?

就且拭目以待。

— 完—