作者:Chip Huyen

翻譯:阿法兔

來源鏈接:https://huyenchip.com/2023/08/16/llm-research-open-challenges.html

讓大語言模型變得更完善這個目標(biāo),是我一生中,第一次見到這么多的聰明人,同時在為一個共同目標(biāo)而努力。在同眾多業(yè)界和學(xué)術(shù)界人士交流后,我注意到出現(xiàn)了十大研究方向。目前受到關(guān)注最多的兩個方向是Hallucinations(輸出幻覺) 和 Context Learning。

而對我自己來說,最感興趣的是下面列出的第 3 個方向(Multimodality多模態(tài)數(shù)據(jù)模式)、第 5 個方向(New architecture 新架構(gòu))和第 6 個方向(GPU alternatives開發(fā)GPU替代的解決方案)

LLM 研究的十大公開挑戰(zhàn)1. 減少和評估幻覺減少并評估輸出輸出(虛構(gòu)信息)

優(yōu)化上下文長度和上下文構(gòu)建

融合其他數(shù)據(jù)形式

提升語言模型的速度和成本效益

設(shè)計新的模型架構(gòu)

開發(fā)替代GPU的解決方案

提升代理(人工智能)的可用性

改進(jìn)從人類偏好中學(xué)習(xí)的能力

提高聊天界面的效率

構(gòu)建用于非英語語言的語言模型

輸出環(huán)境是一個已經(jīng)被大量討論過的話題,所以這里我會長話短說。當(dāng)人工智能模型胡編亂造時,就會產(chǎn)生幻覺。對于許多創(chuàng)意用例來說,幻覺屬于功能的一種。然而,對于大多數(shù)應(yīng)用場景來說,幻覺屬于一種錯誤。最近,我與 Dropbox、LangchAIn、Elastics 和 Anthropic 的專家共同參加了一個關(guān)于 LLM 的專題討論會,在他們看來,企業(yè)在實際生產(chǎn)中,應(yīng)用 LLM 需要克服的首要障礙就是幻覺輸出。

降低模型的幻覺輸出和制定評估幻覺輸出的指標(biāo),是一個蓬勃發(fā)展的研究課題,目前很多初創(chuàng)公司都在關(guān)注這個問題。還有一些技巧可以減少幻覺輸出的概率,例如在提示詞中添加更多上下文、CoT、自洽性,或者特定要求模型的響應(yīng)簡潔明了。

下面是關(guān)于幻覺輸出的系列論文和參考資料:

Survey of Hallucination in Natural Language Generation(Ji et al., 2022)

How Language Model Hallucinations Can Snowball(Zhang et al., 2023)

A Multitask, Multilingual, Multimodal Evaluation of ChatGPT on Reasoning, Hallucination, and Interactivity(Bang et al., 2023)

Contrastive Learning Reduces Hallucination in Conversations(Sun et al., 2022)

Self-Consistency Improves Chain of Thought Reasoning in Language Models(Wang et al., 2022)

SelfCheckGPT: Zero-Resource Black-Box Hallucination Detection for Generative Large Language Models(Manakul et al., 2023)

A simple example of fact-checking and hallucination by NVIDIA’s NeMo-Guardrails

2.優(yōu)化上下文長度和上下文構(gòu)建

絕大部分問題都需要上下文。例如,如果我們問ChatGPT:“哪家越南餐廳最好?”所需的上下文將是“這個餐廳的限定范圍到底在哪里?”,因為越南本土最好吃的餐廳與美國的最好吃的越南餐廳,這個問題的范圍是不同的。

根據(jù)下面這篇很酷的論文《 SITUATEDQA: Incorporating Extra-Linguistic Contexts into QA 》(Zhang&Choi,2021),有相當(dāng)一部分信息搜索問題的答案與上下文有關(guān),例如,在Natural Questions NQ-Open 數(shù)據(jù)集中大約占 16.5%。

(NQ-Open:https://ai.google.com/research/NaturalQuestions)

我個人認(rèn)為,在企業(yè)實際遇到的案例中,這一比例會更高。例如,假設(shè)一家公司為客戶支持建立了一個聊天機器人,要讓這個聊天機器人回答客戶關(guān)于任何產(chǎn)品的任何問題,所需的上下文很可能是該客戶的歷史或該產(chǎn)品的信息。由于語言模型會從提供給它的上下文中 "學(xué)習(xí)",因此這一過程也被稱為上下文學(xué)習(xí)。

圖片客戶支持查詢所需的上下文

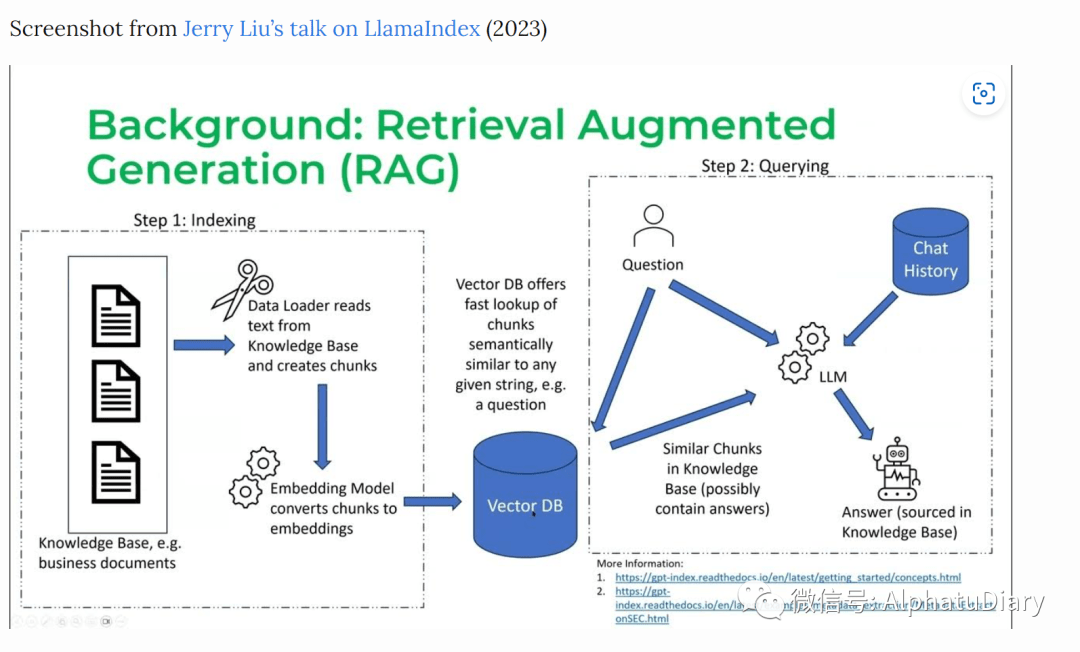

Context length 對于RAG(檢索增強生成)非常重要,而RAG已成為大語言模型行業(yè)應(yīng)用場景的主要模式。具體來說,檢索增強生成主要分為兩個階段:

第 1 階段:分塊(也稱為編制索引)chunking (also known as indexing)

收集LLM使用的所有文檔,將這些文檔分成可以喂入大于模型,以生成嵌入的塊,并將這些嵌入存儲在向量數(shù)據(jù)庫中。

第2階段:查詢

當(dāng)用戶發(fā)送查詢時,如 "我的保險單是否能夠支付某種藥物 X",大語言模型會將此查詢轉(zhuǎn)換為embedding,我們稱之為 QUERY_EMBEDDING。向量數(shù)據(jù)庫,會獲取embedding與 QUERY_EMBEDDING 最相似的塊。

上下文長度越長,我們就能在上下文中squeeze越多的chunks 。模型獲取的信息越多,它的輸出和回應(yīng)質(zhì)量就會越高,是這樣的嗎?

并非總是如此。模型能用多少上下文,和模型使用上下文的效率如何,是兩個不同的問題。在努力增加模型上下文長度的同時,我們也在努力提高上下文的效率。有人稱之為 "提示工程prompt engineering "或 "prompt construction"。例如,最近有一篇論文談到了模型如何更好地理解索引開頭和結(jié)尾,而不僅是中間的信息——Lost in the Middle: How Language Models Use Long Contexts (Liu et al., 2023).

3. 其他數(shù)據(jù)模式融入(多模態(tài))

在我看來,多模態(tài)是非常強大的,但是它也同樣被低估了。這里解釋一下多模態(tài)的應(yīng)用原因:

首先,許多具體應(yīng)用場景都需要多模態(tài)數(shù)據(jù),尤其是在醫(yī)療保健、機器人、電子商務(wù)、零售、游戲、娛樂等混合數(shù)據(jù)模態(tài)的行業(yè)。舉例來說:

醫(yī)療檢測通常需要文本(如醫(yī)生筆記、患者問卷)和圖像(如 CT、X 光片、核磁共振掃描片)。

產(chǎn)品的Metadata通常包含圖片、視頻、描述,甚至表格數(shù)據(jù)(如生產(chǎn)日期、重量、顏色),因為從需求角度,您可能會需要根據(jù)用戶的評論或產(chǎn)品照片,自動填補缺失的產(chǎn)品信息,或者希望讓用戶能夠使用形狀或顏色等視覺信息,進(jìn)行產(chǎn)品搜索。

其次,多模態(tài)有望大幅提升模型性能。一個既能理解文本又能理解圖像的模型,難道不應(yīng)該比單一能理解文本的模型表現(xiàn)更好嗎?基于文本的模型,需要大量文本,以至于我們擔(dān)心很快就會用完互聯(lián)網(wǎng)數(shù)據(jù)來訓(xùn)練基于文本的模型。一旦文本耗盡,我們就需要利用其他數(shù)據(jù)模式。

讓我特別興奮的一個使用案例是,多模態(tài)技術(shù)可以讓視障人士瀏覽互聯(lián)網(wǎng)和瀏覽現(xiàn)實世界。

下面是關(guān)于多模態(tài)相關(guān)的系列論文和參考資料:

[CLIP] Learning Transferable Visual Models From Natural Language Supervision(OpenAI, 2021)

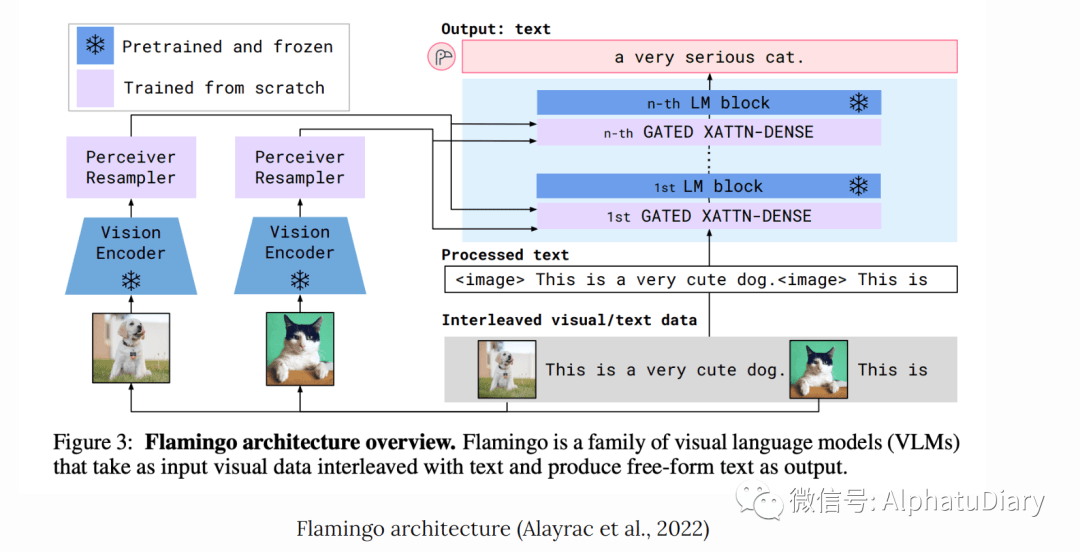

Flamingo: a Visual Language Model for Few-Shot Learning(DeepMind, 2022)

BLIP-2: BootstrApping Language-Image Pre-training with Frozen Image Encoders and Large Language Models(Salesforce, 2023)

KOSMOS-1: Language Is Not All You Need: Aligning Perception with Language Models(Microsoft, 2023)

PaLM-E: An embodied multimodal language model(Google, 2023)

LLaVA: Visual Instruction Tuning(Liu et al., 2023)

NeVA: NeMo Vision and Language Assistant (NVIDIA, 2023)

4. 讓 LLM 更快、成本更低

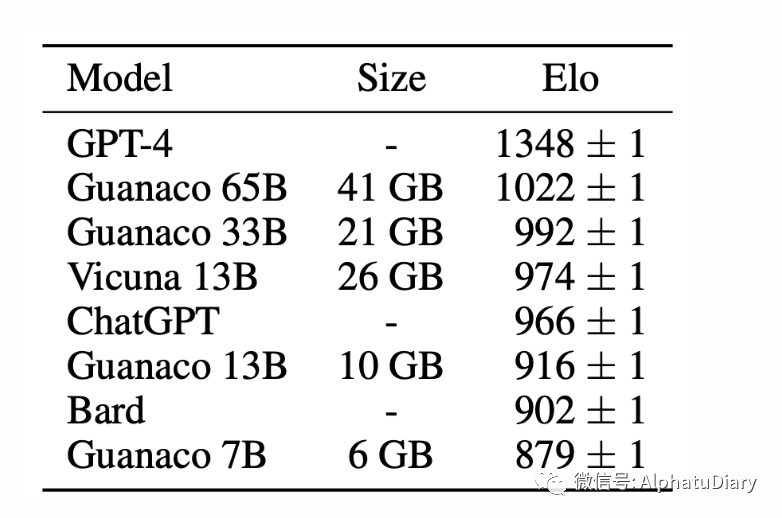

當(dāng)GPT-3.5在2022年11月底首次發(fā)布時,很多人對在生產(chǎn)中使用它的延遲和成本表示擔(dān)憂。然而,自那時以來,延遲/成本分析已經(jīng)迅速發(fā)生了變化。在不到半年的時間里,社區(qū)找到了一種方法,可以創(chuàng)建一個性能與GPT-3.5非常接近的模型,但所需的內(nèi)存占用僅為GPT-3.5的2%左右。

這里的啟示是:如果你創(chuàng)造出足夠優(yōu)秀的東西,人們會找到一種方法讓它變得快速且經(jīng)濟高效。

以下是《Guanaco 7B》的性能數(shù)據(jù),與ChatGPT GPT-3.5和GPT-4的性能進(jìn)行了比較,根據(jù)《Guanco》論文中的報告。請注意:總體而言,下列關(guān)于性能的比較,離完美還差很遠(yuǎn),并且,對LLM的評估非常非常困難。

Guanaco 7B 與 ChatGPT GPT-3.5 和 GPT-4 的性能比較:

四年前,當(dāng)我開始為《設(shè)計機器學(xué)習(xí)系統(tǒng)》一書撰寫后來成為 "模型壓縮 "部分的筆記時,我寫了關(guān)于模型優(yōu)化/壓縮的四種主要技術(shù):

Quantization:迄今為止最通用的模型優(yōu)化方法。量化通過使用較少的位數(shù)來表示模型的參數(shù)來減小模型的大小,例如,可以使用16位甚至4位來表示浮點數(shù),而不是使用32位。5.設(shè)計一種新的模型架構(gòu)Knowledge distillation:一種通過訓(xùn)練小模型來模仿大型模型或模型集合的方法。

Low-rank factorization:這里的關(guān)鍵思路是用低維張量代替高維張量,以減少參數(shù)數(shù)量。例如,可以將 3x3 張量分解為 3x1 和 1x3 張量的乘積,這樣就不再需要 9 個參數(shù),而只需要 6 個參數(shù)。

Pruning

所有上述四種技術(shù)在今天仍然適用和流行。Alpaca 采用Knowledge distillation進(jìn)行訓(xùn)練。QLoRA 結(jié)合使用了Low-rank factorization和quantization。

自 2012 年的 Ale.NET 以來,我們看到了許多架構(gòu)的興衰,包括 LSTM、seq2seq 等。與這些相比,Transformer 的影響力,令人難以置信。自 2017 年以來,Transformer 就一直存在,而這種架構(gòu)還能流行多久,還是個未解之謎。

開發(fā)一種新架構(gòu)來超越 Transformer 并不容易。Transformer 在過去 6 年中進(jìn)行了大量優(yōu)化,而這種新架構(gòu),必須在人們當(dāng)前關(guān)注的硬件,以當(dāng)前關(guān)心的規(guī)模運行。

注意:谷歌最初設(shè)計 Transformer 是為了在 TPU 上快速運行,后來才在 GPU 上進(jìn)行了優(yōu)化。

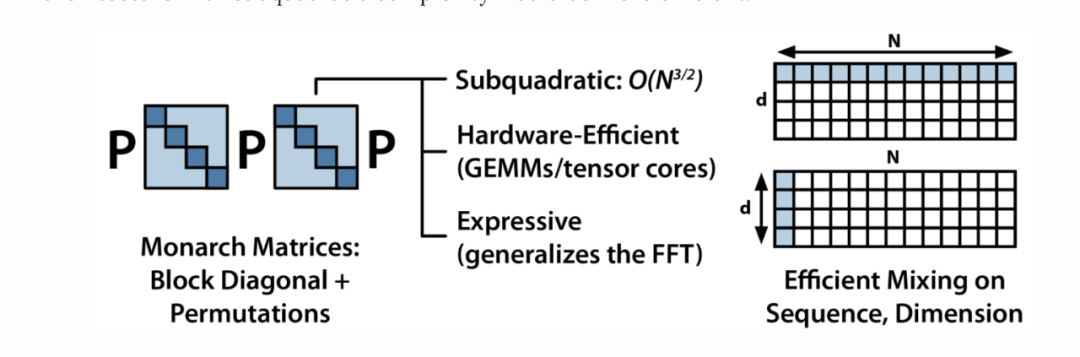

2021 年,Chris Ré's lab的 S4 引起了廣泛關(guān)注,詳見《Efficiently Modeling Long Sequences with Structured State Spaces 》(Gu et al., 2021))。Chris Ré's lab仍在大力開發(fā)新架構(gòu),最近與初創(chuàng)公司 Together 合作開發(fā)的架構(gòu) Monarch Mixer(Fu ,2023 年)就是其中之一。

他們的主要思路是,對于現(xiàn)有的 Transformer 架構(gòu),注意力的復(fù)雜度是序列長度的二次方,而 MLP 的復(fù)雜度是模型維度的二次方。具有次二次方復(fù)雜度的架構(gòu)將更加高效。

Monarch Mixer

6. 開發(fā) GPU 替代方案

自2012年的AlexNet以來,GPU一直是深度學(xué)習(xí)的主導(dǎo)硬件。實際上,AlexNet受歡迎的一個普遍認(rèn)可的原因之一是它是首篇成功使用GPU來訓(xùn)練神經(jīng)網(wǎng)絡(luò)的論文。在GPU出現(xiàn)之前,如果想要以AlexNet的規(guī)模訓(xùn)練模型,需要使用數(shù)千個CPU,就像谷歌在AlexNet之前幾個月發(fā)布的那款。與數(shù)千個CPU相比,幾塊GPU對于博士生和研究人員來說更加容易得到,從而引發(fā)了深度學(xué)習(xí)研究的繁榮。

在過去的十年里,許多公司,包括大型企業(yè)和創(chuàng)業(yè)公司,都試圖為人工智能創(chuàng)建新的硬件。最值得注意的嘗試包括谷歌的TPU、Graphcore的IPU(IPU的進(jìn)展如何?)以及Cerebras。SambaNova籌集了超過十億美元來開發(fā)新的AI芯片,但似乎已轉(zhuǎn)向成為一個生成式AI平臺。

有一段時間,人們對量子計算抱有很大的期望,其中關(guān)鍵參與者包括:

IBM的QPU谷歌的量子計算機在今年早些時候在《自然》雜志上報道了量子誤差減少的重大里程碑。其量子虛擬機可以通過Google Colab公開訪問。

研究實驗室,如麻省理工學(xué)院量子工程中心、馬克斯·普朗克量子光學(xué)研究所、芝加哥量子交流中心、奧克里奇國家實驗室等。

另一個同樣令人興奮的方向是光子芯片(photonic chips)。我對這個領(lǐng)域知之尚淺, 所以,如果有錯誤,請糾正我。現(xiàn)有芯片使用電力來傳輸數(shù)據(jù),這消耗大量的能量并且產(chǎn)生延遲。而光子芯片使用光子來傳輸數(shù)據(jù),利用光速進(jìn)行更快、更高效的計算。在這個領(lǐng)域,各種初創(chuàng)公司已經(jīng)融資數(shù)億美元,包括Lightmatter(2.7億美元)、Ayar Labs(2.2億美元)、Lightelligence(2億美元以上)和Luminous Computing(1.15億美元)。

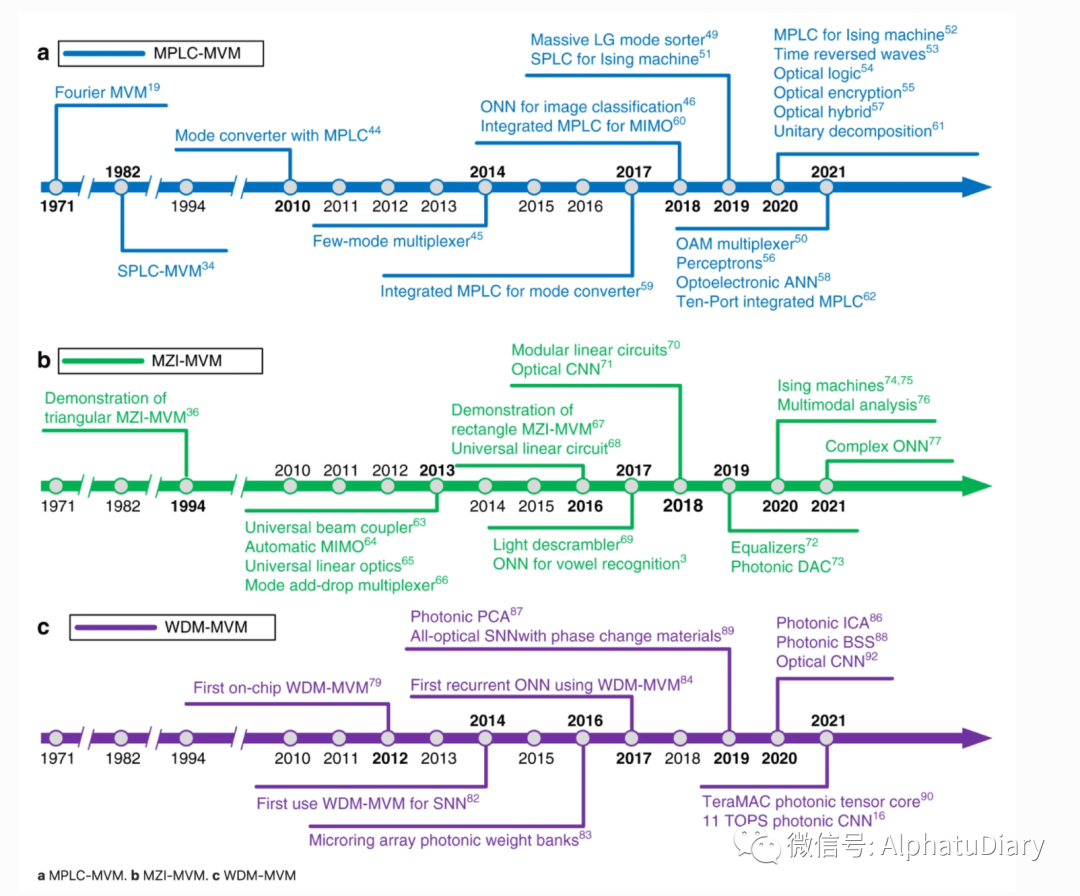

以下是光子矩陣計算三種主要方法的進(jìn)展時間線,摘自論文《Photonic matrix multiplication lights up photonic accelerator and beyond》(Zhou,Nature 2022)。這三種不同的方法分別是平面光轉(zhuǎn)換(PLC)、馬赫-曾德爾干涉儀(MZI)和波分復(fù)用(WDM)。

7. 提高agents的可用性

Agent指可以執(zhí)行動作的大語言模型(可以理解為那些可以代替你來完成各種任務(wù)的代理人,所以叫Agent),例如瀏覽互聯(lián)網(wǎng)、發(fā)送電子郵件、預(yù)訂等。與本文中其他研究方向相比,這可能是最新的方向之一。由于Agent本身的新穎性和巨大潛力,人們對Agent充滿熱情。而Auto-GPT現(xiàn)在是Github上 標(biāo)星數(shù)量排名第25的、最受歡迎的repo。GPT-Engineering是另一個受歡迎的repo。

盡管這個方向令人興奮,但人們?nèi)匀粚Υ笳Z言模型是否足夠可靠和高性能,以及能夠被賦予行動的權(quán)力,存在疑慮。然而,已經(jīng)出現(xiàn)了一個應(yīng)用場景,即將Agent用于社會研究,例如著名的斯坦福實驗,該實驗顯示一小簇生成式Agent產(chǎn)生了新興的社會行為:例如,從一個用戶指定的想法開始,一個Agent想要舉辦情人節(jié)派對,Agent在接下來的兩天里自動傳播派對的邀請,結(jié)交新朋友,互相邀請參加派對...(Generative Agents: Interactive Simulacra of Human Behavior, Park et al., 2023),

在這個領(lǐng)域最值得注意的創(chuàng)業(yè)公司也許是Adept,由兩位前Transformer的合著者和前OpenAI副總裁創(chuàng)立,到目前為止已經(jīng)融資近5億美元。去年,他們展示了他們的agent的如何瀏覽互聯(lián)網(wǎng)的,還有就是演示了如何向Salesforce添加新賬戶。

8. 迭代RLHF

RLHF(從人類反饋中進(jìn)行強化學(xué)習(xí))很酷,但有點技巧性。如果人們找到更好的訓(xùn)練LLM的方法,也不奇怪。不過,在RLHF方面還存在許多未解決的問題,例如:

①如何用數(shù)學(xué)方式,表示人類偏好?

目前,人類偏好是通過比較來確定的:人類標(biāo)注員確定響應(yīng)A是否比響應(yīng)B更好。然而,它沒有考慮響應(yīng)A比響應(yīng)B好多少。

②什么是人類偏好(preference)?

Anthropic根據(jù)輸出,在有益、誠實和無害三個方面對其模型的質(zhì)量進(jìn)行了衡量。請參閱Constitutional AI: Harmlessness from AI Feedback (Bai et al., 2022).

DeepMind試圖生成能夠取悅大多數(shù)人的響應(yīng)。請參閱Fine-tuning language models to find agreement among humans with diverse preferences, (Bakker et al., 2022).

此外,我們想要能夠表達(dá)立場的AI,還是對任何可能具有爭議性的話題回避的傳統(tǒng)AI呢?

③“人類”偏好究竟是誰的偏好,是否要考慮到文化、宗教、政治傾向等的差異?獲得足夠代表所有潛在用戶的訓(xùn)練數(shù)據(jù)存在許多挑戰(zhàn)。

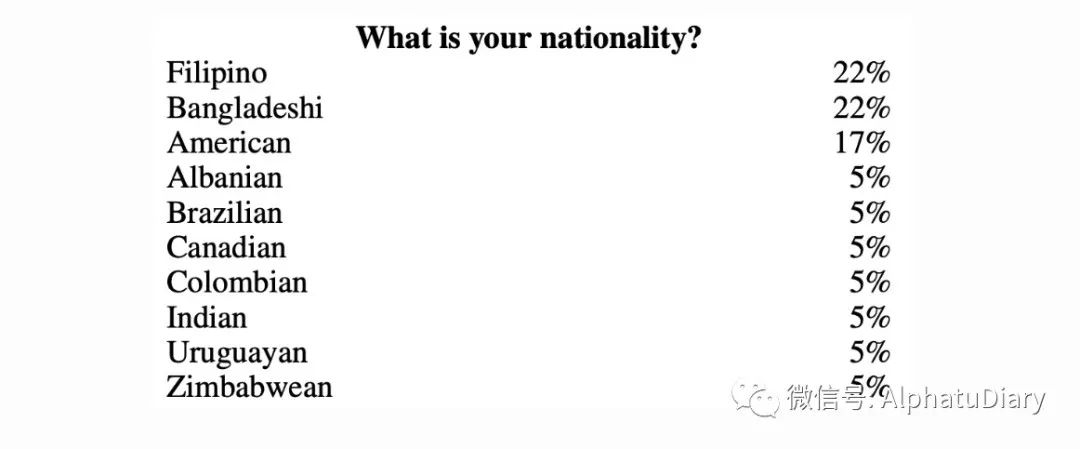

例如,對于OpenAI的InstructGPT數(shù)據(jù),沒有65歲以上的標(biāo)注員。標(biāo)注員主要是菲律賓人和孟加拉人。請參閱InstructGPT: Training language models to follow instructions with human feedback (Ouyang et al., 2022).

InstructGPT標(biāo)注員的國籍統(tǒng)計信息

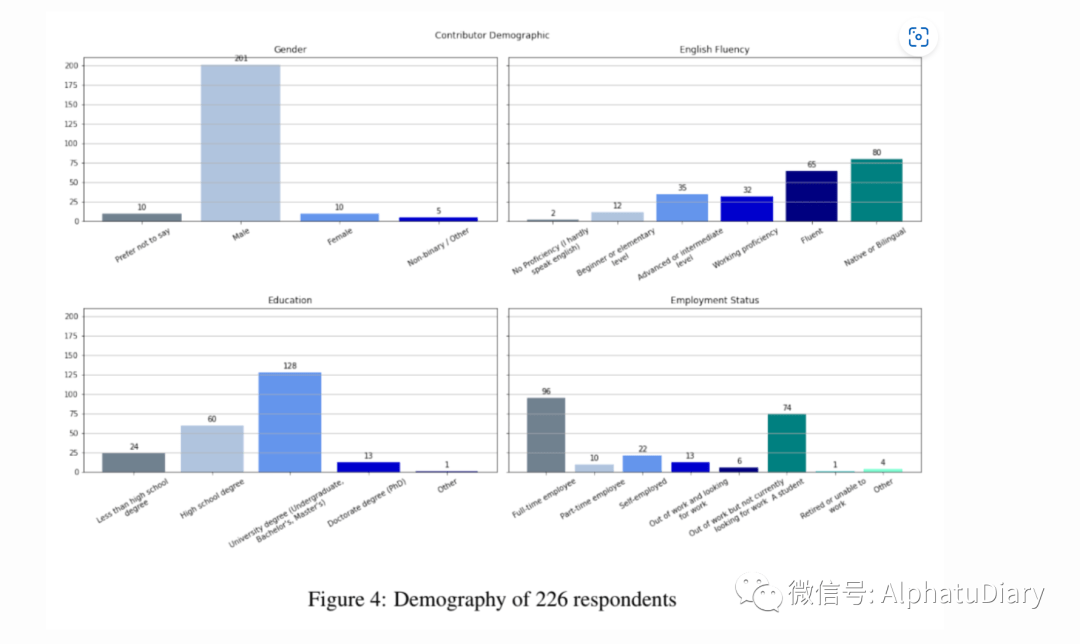

盡管社區(qū)主導(dǎo)的努力在其意圖上值得贊賞,但可能導(dǎo)致數(shù)據(jù)存在偏見。例如,對于OpenAssistant數(shù)據(jù)集,222位(90.5%)回答者中有201位自我認(rèn)定為男性。Jeremy Howard在Twitter上有一個很好的Thread:

9.提高聊天界面效率

自 ChatGPT 以來,人們一直在討論聊天是否是一個適用于各種任務(wù)的界面。

詳見:

Natural language is the lazy user interface(Austin Z. Henley, 2023)

Why Chatbots Are Not the Future(Amelia Wattenberger, 2023)

What Types of Questions Require Conversation to Answer? A Case Study of AskReddit Questions(Huang et al., 2023)

AI chat interfaces could become the primary user interface to read documentation(Tom Johnson, 2023)

Interacting with LLMs with Minimal Chat (Eugene Yan, 2023)

然而,這并不是一個新話題。在許多國家,尤其是在亞洲,聊天已經(jīng)作為超級應(yīng)用的界面使用了大約十年時間,Dan Grover在2014年就已經(jīng)寫過相關(guān)論文。

2016 年,當(dāng)許多人認(rèn)為應(yīng)用程序已死、聊天機器人將成為未來時,討論再次變得激烈緊張起來:

On chat as interface(Alistair Croll, 2016)

Is the Chatbot Trend One Big Misunderstanding?(Will Knight, 2016)

Bots won’t replace apps. Better apps will replace apps (Dan Grover, 2016)

我個人喜歡聊天界面,原因如下:

①聊天界面是每個人,甚至是沒有先前接觸過計算機或互聯(lián)網(wǎng)的人,都可以迅速學(xué)會使用的界面(普適性)。在2010年代初,當(dāng)我在肯尼亞的一個低收入居民區(qū)做志愿者時,我驚訝于那里的每個人在手機上進(jìn)行銀行業(yè)務(wù)時是多么熟悉,通過短信。那個社區(qū)沒有人有計算機。

② 聊天界面是易于訪問的。如果你的雙手整忙于其他事情,可以使用語音而不是文本。

③ 聊天也是一個非常強大的界面--你可以向它提出任何請求,它都會給予回復(fù),即使回復(fù)不一定完美

不過,筆者認(rèn)為聊天界面在某些方面還可以繼續(xù)改進(jìn):

①單次可交流多條消息

目前,我們基本上假設(shè)每次交流只有單輪消息。但這不是我和我的朋友發(fā)短信的方式。通常,我需要多條消息來完成我的思考,因為我需要插入不同的數(shù)據(jù)(例如圖像、位置、鏈接),我可能在之前的消息中遺漏了某些內(nèi)容,或者只是不想把所有內(nèi)容都放在單一的大段落里。

②多模態(tài)輸入

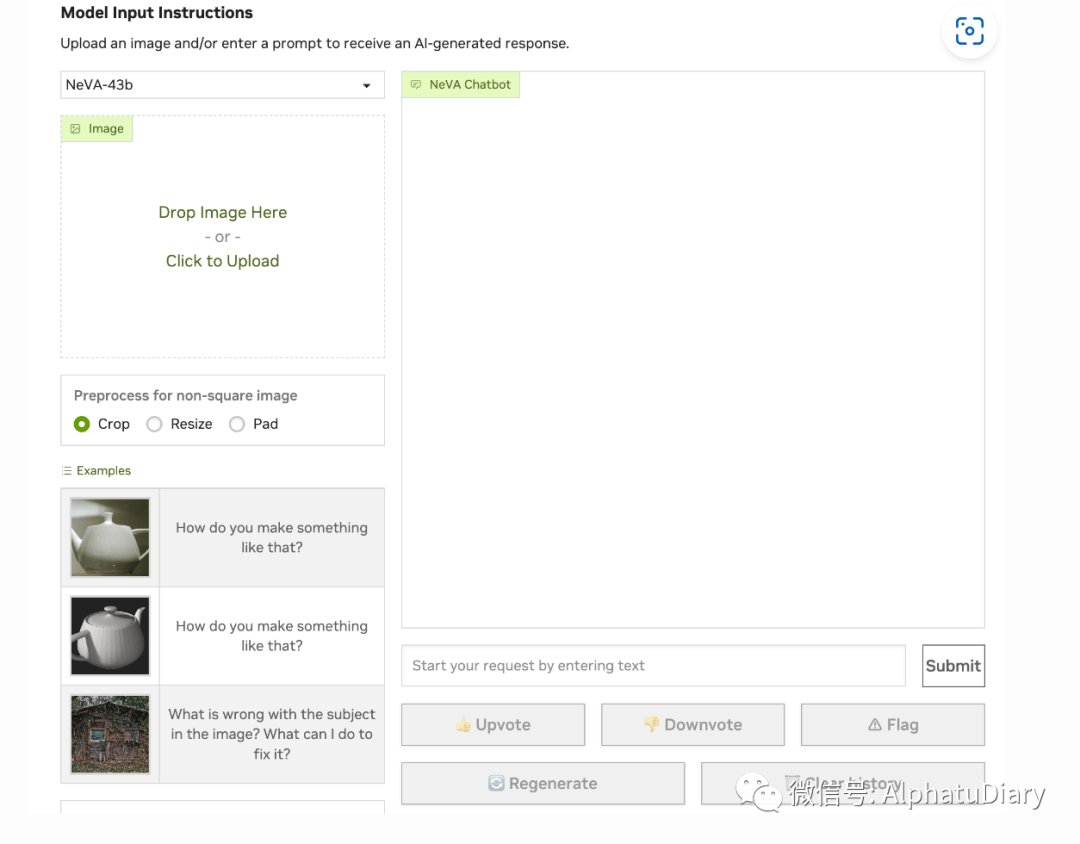

在多模態(tài)應(yīng)用領(lǐng)域,大部分精力都花在構(gòu)建更好的模型上,而很少花在構(gòu)建更好的界面上。以Nvidia的NeVA聊天機器人為例。我不是用戶體驗專家,但我認(rèn)為在這里可能有改進(jìn)的空間。

附注:對這里提到NeVA團(tuán)隊表示抱歉,即使有了這個,你們的工作仍然非常酷!

③將生成式AI融入工作流程中

Linus Lee在他的分享“Generative AI interface beyond chats.”中很好地涵蓋了這一點。例如,如果您想問關(guān)于您正在處理的圖表中的某一列的問題,您應(yīng)該能夠只需指向那一列并提問。

④消息編輯和刪除

用戶輸入的編輯或刪除會如何改變與聊天機器人的對話流程?

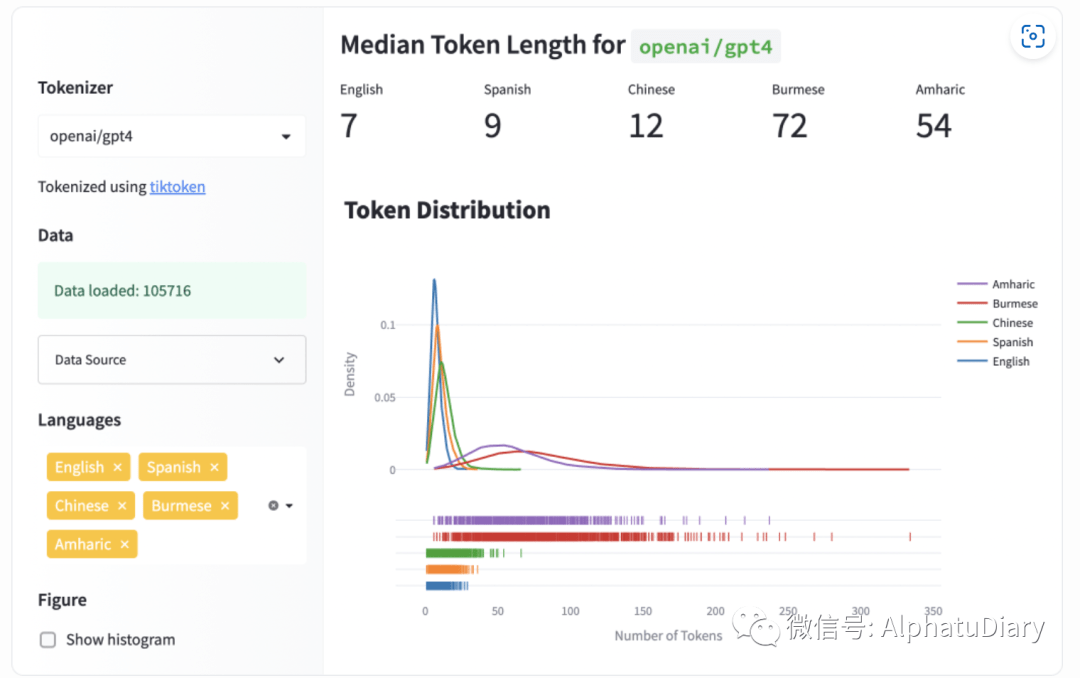

10. 為非英語語言創(chuàng)建 LLM

我們知道,目前以英語為第一語言的 LLM 在性能、延遲和速度方面都無法很好地適用于許多其他語言。請參閱:

ChatGPT Beyond English: Towards a Comprehensive Evaluation of Large Language Models in Multilingual Learning(Lai et al., 2023)

All languages are NOT created (tokenized) equal (Yennie Jun, 2023)

我只知道訓(xùn)練越南語的嘗試(比如Symato 社區(qū)嘗試),不過,本文幾位早期讀者告訴我,他們認(rèn)為我不應(yīng)該把這個方向包括進(jìn)來,原因如下:

這與其說是一個研究問題,不如說是一個logistics問題。我們已經(jīng)知道如何去做,只是需要有人投入資金和精力。不過,這并不完全正確。大多數(shù)語言都被認(rèn)為是low-resource語言,例如,與英語或中文相比,很多語種的高質(zhì)量數(shù)據(jù)要少得多,因此可能需要不同的技術(shù)來訓(xùn)練大型語言模型。參見:

Low-resource Languages: A Review of Past Work and Future Challenges(Magueresse et al., 2020)

JW300: A Wide-Coverage Parallel Corpus for Low-Resource Languages (Agi? et al., 2019)

那些更為悲觀的人認(rèn)為,在未來,許多語言將會消失,互聯(lián)網(wǎng)將由兩個語言組成的兩個宇宙:英語和漢語。這種思潮并不新鮮 - 有人還記得Esperanto嗎?

人工智能工具,例如機器翻譯和聊天機器人,對語言學(xué)習(xí)的影響仍然不明確。它們會幫助人們更快地學(xué)習(xí)新語言,還是會完全消除學(xué)習(xí)新語言的需求。

結(jié)論

本文如有任何遺漏,請告知我,為了獲取其他觀點,請查閱這篇全面的論文《Challenges and Applications of Large Language Models (Kaddour et al., 2023).

上述問題比其他問題更加困難。例如,我認(rèn)為上述第10個問題,即建立非英語語言的 LLM,只要有足夠的時間和資源,就會比較簡單。

上述第 1 個問題是減少幻覺輸出,這將會難得多,因為幻覺只是 LLM 在做概率的事情。

第 4 ,讓 LLM 更快、更便宜,這一點永遠(yuǎn)無法徹底解決。這方面已經(jīng)取得了很大進(jìn)展,以后還會有更多進(jìn)展,但是這個方向的改進(jìn)將會一直持續(xù)。

第 5 項和第 6 項,即新架構(gòu)和新硬件,非常具有挑戰(zhàn)性,但隨著時間的推移,它們是不可避免的。由于架構(gòu)和硬件之間的共生關(guān)系——新架構(gòu)需要針對通用硬件進(jìn)行優(yōu)化,而硬件需要支持通用架構(gòu),它們可能會由同一家公司來完成。

有些問題僅靠技術(shù)知識是無法解決的。例如,第 8 個問題,即改進(jìn)從人類偏好中學(xué)習(xí)的方法,可能更多的是一個政策問題,而不是技術(shù)問題。第 9 個問題是提高聊天界面的效率,這更像是用戶體驗問題。我們需要更多具有非技術(shù)背景的人員與我們一起解決這些問題。

你最感興趣的研究方向是什么?認(rèn)為最有希望解決這些問題的方案是什么?很想聽聽您的意見。