機器之心報道

機器之心編輯部

Stability AI 的視頻生成模型看來效果不錯。

AI 畫圖的著名公司 Stability AI,終于入局 AI 生成視頻了。

本周二,基于 Stable Diffusion 的視頻生成模型 Stable Video Diffusion 來了,AI 社區馬上開始了熱議。

很多人都表示「我們終于等到了」。

項目地址:https://Github.com/Stability-AI/generative-models

現在,你可以基于原有的靜止圖像來生成一段幾秒鐘的視頻。

基于 Stability AI 原有的 Stable Diffusion 文生圖模型,Stable Video Diffusion 成為了開源或已商業行列中為數不多的視頻生成模型之一。

但目前還不是所有人都可以使用,Stable Video Diffusion 已經開放了用戶候補名單注冊(

https://stability.ai/contact)。

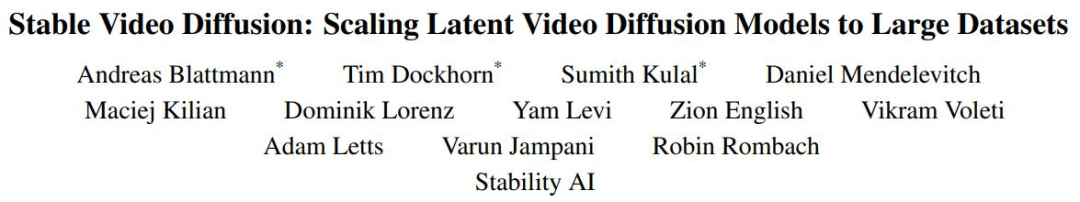

據介紹,Stable Video Diffusion 可以輕松適應各種下游任務,包括通過對多視圖數據集進行微調從單個圖像進行多視圖合成。Stability AI 表示,正在計劃建立和擴展這個基礎的各種模型,類似于圍繞 stable diffusion 建立的生態系統。

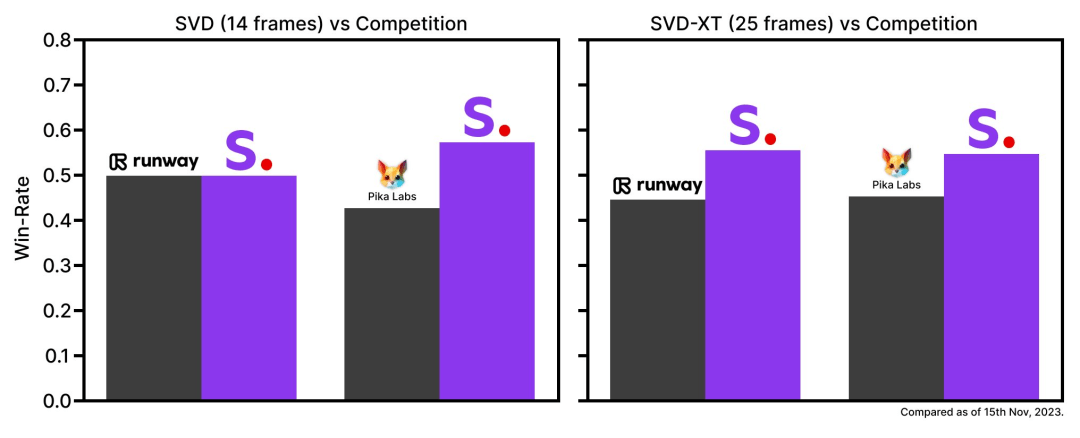

Stable Video Diffusion 以兩種圖像到視頻模型的形式發布,能夠以每秒 3 到 30 幀之間的可定制幀速率生成 14 和 25 幀的視頻。

在外部評估中,Stability AI 證實這些模型超越了用戶偏好研究中領先的閉源模型:

Stability AI 強調,Stable Video Diffusion 現階段不適用于現實世界或直接的商業應用,后續將根據用戶對安全和質量的見解和反饋完善該模型。

論文地址:https://stability.ai/research/stable-video-diffusion-scaling-latent-video-diffusion-models-to-large-datasets

Stable Video Diffusion 是 Stability AI 各式各樣的開源模型大家族中的一員。現在看來,他們的產品已經橫跨圖像、語言、音頻、三維和代碼等多種模態,這是他們致力于提升 AI 最好的證明。

Stable Video Diffusion 的技術層面

Stable Video Diffusion 作為一種高分辨率的視頻潛在擴散模型,達到了文本到視頻或圖像到視頻的 SOTA 水平。近期,通過插入時間層并在小型高質量視頻數據集上進行微調,為 2D 圖像合成訓練的潛在擴散模型已轉變為生成視頻模型。然而,文獻中的訓練方法千差萬別,該領域尚未就視頻數據整理的統一策略達成一致。

在 Stable Video Diffusion 的論文中,Stability AI 確定并評估了成功訓練視頻潛在擴散模型的三個不同階段:文本到圖像預訓練、視頻預訓練和高質量視頻微調。他們還證明了精心準備的預訓練數據集對于生成高質量視頻的重要性,并介紹了訓練出一個強大基礎模型的系統化策劃流程,其中包括了字幕和過濾策略。

Stability AI 在論文中還探討了在高質量數據上對基礎模型進行微調的影響,并訓練出一個可與閉源視頻生成相媲美的文本到視頻模型。該模型為下游任務提供了強大的運動表征,例如圖像到視頻的生成以及對攝像機運動特定的 LoRA 模塊的適應性。除此之外,該模型還能夠提供強大的多視圖 3D 先驗,這可以作為多視圖擴散模型的基礎,模型以前饋方式生成對象的多個視圖,只需要較小的算力需求,性能還優于基于圖像的方法。

具體而言,成功訓練該模型包括以下三個階段:

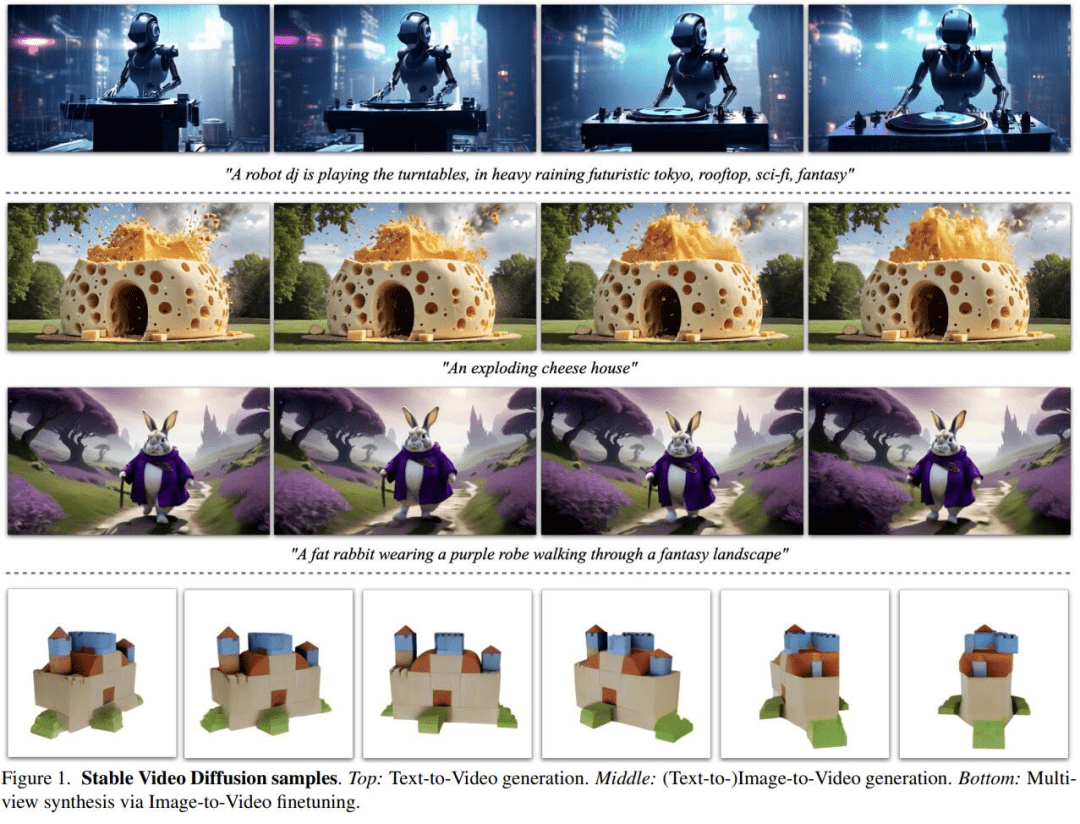

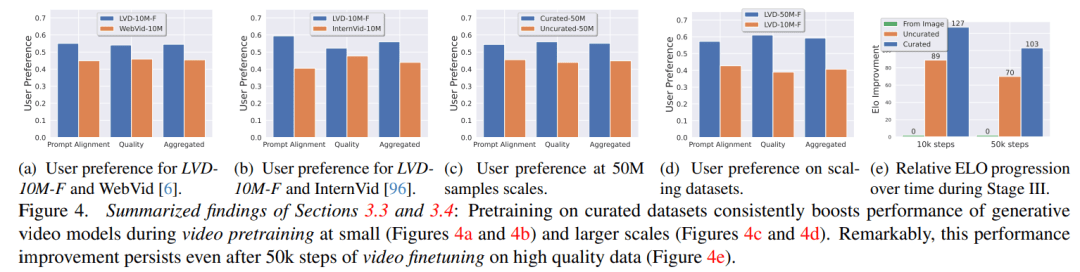

階段一:圖像預訓練。本文將圖像預訓練視為訓練 pipeline 的第一階段,并將初始模型建立在 Stable Diffusion 2.1 的基礎上,這樣一來為視頻模型配備了強大的視覺表示。為了分析圖像預訓練的效果,本文還訓練并比較了兩個相同的視頻模型。圖 3a 結果表明,圖像預訓練模型在質量和提示跟蹤方面都更受青睞。

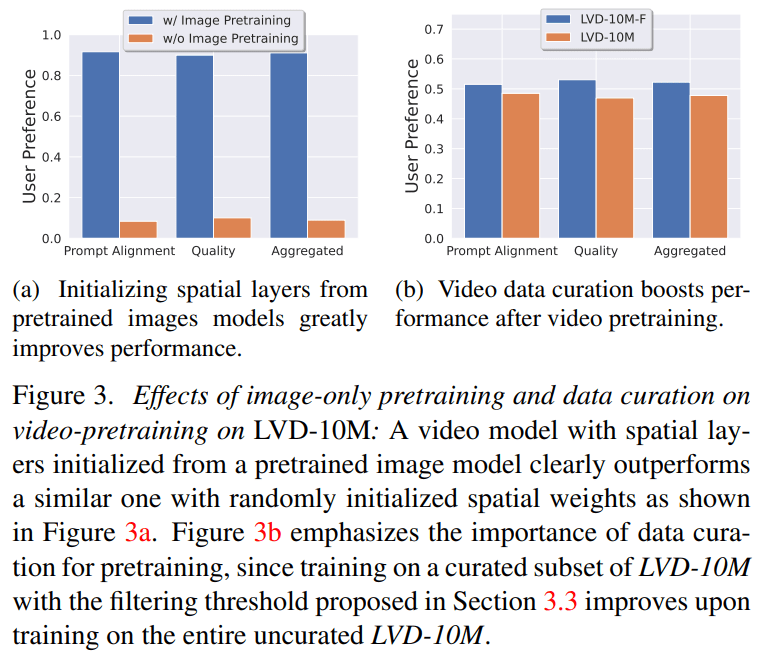

階段 2:視頻預訓練數據集。本文依靠人類偏好作為信號來創建合適的預訓練數據集。本文創建的數據集為 LVD(Large Video Dataset ),由 580M 對帶注釋的視頻片段組成。

進一步的研究表明生成的數據集包含可能會降低最終視頻模型性能的示例。因此,本文還采用了密集光流來注釋數據集。

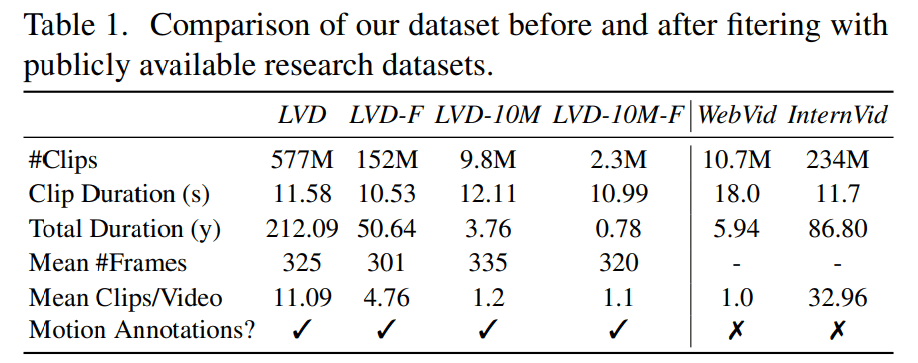

此外,本文還應用光學字符識別來清除包含大量文本的剪輯。最后,本文使用 CLIP 嵌入來注釋每個剪輯的第一幀、中間幀和最后一幀。下表提供了 LVD 數據集的一些統計信息:

階段 3:高質量微調。為了分析視頻預訓練對最后階段的影響,本文對三個模型進行了微調,這些模型僅在初始化方面有所不同。圖 4e 為結果。

看起來這是個好的開始。什么時候,我們能用 AI 直接生成一部電影呢?

參考內容:

https://stability.ai/news/stable-video-diffusion-open-ai-video-model

https://news.ycombinator.com/item?id=38368287